Autonome Waffen made in Germany

Immer mehr deutsche Firmen entwickeln Künstliche Intelligenz für militärische Zwecke. Sie treiben den Wandel in der Kriegsführung mit an. Offen ist, wie viel Kontrolle dem Menschen noch bleibt.

Am Morgen des 28. Februar 2026 schlägt eine Tomahawk-Rakete in eine Grundschule in der südiranischen Stadt Minab ein. Das Gebäude stürzt ein. Mehr als 150 Menschen sterben – die meisten von ihnen Kinder.

Frühe Untersuchungen deuten laut eines Medienberichts darauf hin, dass es sich dabei um einen verheerenden Fehler handelte: die USA und Israel haben in den Anfangstagen des Konflikts im Iran Tausende Raketenangriffe mithilfe Künstlicher Intelligenz (KI) entschieden. Man griff dabei offenbar teils auf veraltetes Kartenmaterial zurück: Das Gebäude der Schule gehörte vor einigen Jahren noch zu einer Kaserne. Der Vorfall beschäftigt mittlerweile auch die Vereinten Nationen.

KI-Systeme durchdringen die ganze Gesellschaft. Sie verändern längst auch Kriege. Im Hintergrund liefern Militärmächte sich ein technologisches Rennen: Die sogenannte Kill Chain, also die Schritte während eines militärischen Angriffs, lassen sich durch den Einsatz von KI drastisch komprimieren. Entscheidungen fallen schneller, Prozesse werden automatisiert. Auch Deutschland ist Teil und Treiber dieser Entwicklung.

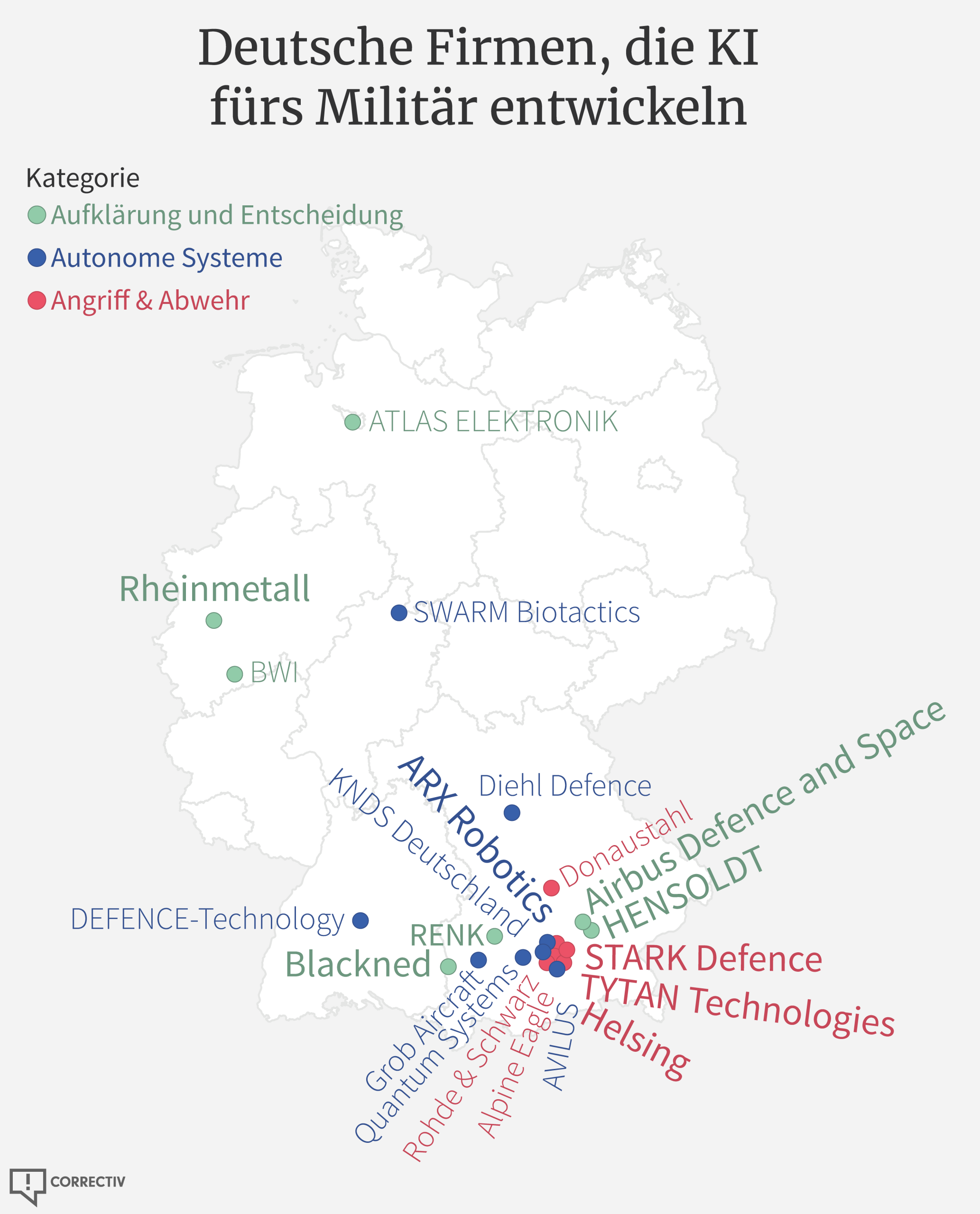

CORRECTIV konnte mindestens 21 deutsche Firmen ausmachen, die KI dezidiert für militärische Zwecke entwickeln. Die meisten befinden sich im Ballungsraum München.

Die Entwicklungen dieser Firmen decken einen Großteil der militärischen Bandbreite ab und werden zunehmend eingesetzt: Es geht um Feldaufklärung, um Entscheidungshilfe für die Gefechtsführung, aber auch um autonome Fahrzeuge und Angriffswaffen. Einige haben bereits Verträge mit der Bundeswehr abgeschlossen.

Bei Fachleuten gelten die Technologien und ihr Einsatz im Militär weitgehend als Blackbox: Für die Öffentlichkeit sei nur sehr schwer nachvollziehbar, wie sie entwickelt und überprüft werden.

KI-Systeme im militärischen Bereich bergen große Risiken. Über allem steht eine Grundsatzfrage: Wie viel Kontrolle darf der Mensch im Krieg aus der Hand geben?

Kapitel 1: Das Rennen um Militärtechnologie

Neben dem Konflikt im Iran zeigt sich wohl nirgends deutlicher als in der Ukraine, wie sehr sich die Kriegsführung in den letzten Jahren verändert hat: Russlands Einsatz von mit Sprengstoff bestückten Drohnen prägt dort einen Alltag, in dem sich kaum noch jemand sicher fühlen kann.

Unter anderem diese Drohnen werden in der Ukraine eingesetzt

Drohnen können im Krieg für Aufklärungsflüge oder als klassische Waffe mit Munition oder Sprengsatz eingesetzt werden.

Kleine, provisorische Varianten werden FPV-Drohnen genannt. Die Abkürzung steht für First-Person-View; ein gängiger Begriff aus Videospielen. Dabei werden die Drohnen aus der Ferne von Soldaten aus der Ich-Perspektive gesteuert – also aus der Sicht des fliegenden Objekts.

Größere, schwerere Drohnen werden im Fachjargon als Loitering Munition bezeichnet, bekannt sind sie auch als Kamikaze-Drohnen. Sie sind mit komplexer Technologie ausgestattet und können ihre Ziele autonom finden und angreifen – diese Aufgabe übernimmt dann eine KI.

Ukrainische Soldaten und die Zivilbevölkerung im Frontgebiet müssen sich teils gegen Drohnen zur Wehr setzen, die ihnen in Unterstände, Erdlöcher und Wohnungen folgen. Die Taktik der russischen Angreifer gegen Zivilisten nennen Journalisten zynisch: Human Safari.

Der technologische Fortschritt ist zu einer Art Lebensversicherung für die ukrainische Bevölkerung geworden. Das Land produziert pro Jahr vier Millionen Drohnen, nach Einschätzung von Analysten mehr als alle NATO-Mitglieder zusammen. Der nächste Durchbruch beim Einsatz ist zum Greifen nah: Schwarmtechnologie.

Vereinfacht gesagt geht es darum, dass ein Soldat eine Vielzahl von Drohnen koordinieren kann, sodass sie zusammenarbeiten und gemeinsam angreifen können, ähnlich einem Bienenschwarm. Ukrainische Militärs gehen davon aus, dass diese Fähigkeit künftig zumindest kampfentscheidend sein könnte. Ein Schlüssel dabei: der Einsatz von KI, um die Fluggeräte miteinander zu vernetzen und zu orchestrieren.

Rund zweitausend Kilometer von der Front entfernt, in München, sitzt eine neue Generation von Entwicklerinnen und Programmierern, die das Geschehen in der Ukraine genau analysieren. Denn die deutsche Rüstungsindustrie will Schritt halten.

Die Bundesregierung plant, angesichts der Bedrohung aus Russland, Milliardensummen für militärische Spitzentechnik auszugeben.

München und sein direktes Umland sind in den vergangenen Jahren zu einer Hochburg der Entwicklung rund um KI-gestützte Drohnen aus Deutschland geworden, wie eine Analyse von CORRECTIV zeigt. Mindestens 13 überwiegend junge Unternehmen liefern sich dort ein Rennen um die heißeste Technologie, die sie der Bundeswehr anbieten.

Viele Militärs setzen zunehmend auf das Konzept des sogenannten Precision Mass Warfare – die Verbindung von hochpräzisen Waffensystemen mit der Fähigkeit, sie in großer Zahl einzusetzen. Insbesondere Drohnen verkörpern diese Logik: Sie sind vergleichsweise günstig, präzise und lassen sich massenhaft einsetzen.

Zugleich ermöglichen KI und vernetzte Systeme eine koordinierte Nutzung dieser Waffen. Drohnen und andere unbemannte Systeme liefern Echtzeitdaten, führen präzise Schläge aus und können in Schwärmen operieren.

Im Hintergrund müssen dafür mehrere Systeme zusammenwirken: Aufklärung, Sensorik, Big-Data-Analyse, Entscheidungshilfe bei der Zielerkennung, Vernetzung von IT-Systemen und mehr. Deutsche Firmen decken diese Bandbreite mittlerweile fast gänzlich ab. Teils kooperieren sie, um Rückstände in einzelnen Bereichen auszugleichen.

Ein Knotenpunkt dieser Kooperationen ist das junge Münchner Unternehmen Helsing. Strategische Partnerschaften gibt es etwa mit Hensoldt, Arx Robotics und Airbus Defence and Space.

Die Entwicklungsabteilungen der Rüstungsunternehmen arbeiten auch daran, den Ablauf militärischer Angriffe effizienter zu gestalten. Künstliche Intelligenz soll dabei helfen.

Im Militärjargon wird dieser Ablauf unter einem drastischen Begriff zusammengefasst: Kill Chain.

Kapitel 2: Schneller, tödlicher

Die sogenannte Kill Chain beschreibt die Schritte eines militärischen Angriffs. In der Regel sind das: Ziel finden, fixieren, verfolgen, zur Bekämpfung auswählen, angreifen, auswerten.

Eine zentrale Fragestellung in militärischen Entwicklungslaboren und Strategieüberlegungen ist: Wer übernimmt innerhalb dieser Kette welche Aufgaben? Was übernimmt der Mensch, was die Maschine?

Frank Sauer von der Bundeswehr-Universität in München forscht zum Verhältnis zwischen Technologie und Sicherheit. Er beschäftigt sich seit zwei Jahrzehnten mit der Nutzung von Robotik und KI im Militär und damit, wie die Technologien Kriege verändern.

„Es wird alles schneller und tödlicher“, sagt Sauer gegenüber CORRECTIV. KI-Systeme, die im Zusammenspiel militärische Entscheidungen abnehmen, sogenannte Decision Support Systems, könnten laut ihm eine enorme Geschwindigkeit generieren. Sie komprimieren quasi die ersten Schritte der Kill Chain.

Gezeigt habe sich das Phänomen etwa bei den Angriffen der USA und Israel auf den Iran. „Tausende Ziele an nur einem Tag zu identifizieren und zu attackieren, das war vor ein paar Jahren noch völlig undenkbar“, sagt der Experte.

Der zweite Aspekt, der sich laut Sauer verschärfe, sei die Tödlichkeit durch neue Waffensysteme. Wie etwa Drohnen, die auch in Innenräume eindringen können oder in Schwärmen attackieren. Gegner werden früher entdeckt und gezielt verfolgt.

Deutsche Firmen wie Helsing, Stark, Tytan oder Arx Robotics spielen nach Einschätzung des Experten vorne mit, wenn es um KI-Entwicklungen für diese schnelle und vernetzte Form der Gefechtsführung geht.

Rein technisch sei mittlerweile jeder Schritt der Kill Chain laut Sauer komplett ohne das Zutun eines Menschen machbar, bis hin zum tatsächlichen Angriff. „Es ist aber ein wesentliches Risiko, dass ich da womöglich nicht mehr genug menschliche Urteilskraft und Kontrolle in diesen Vorgängen habe.“ Gezeigt habe sich das unter anderem in Gaza.

Dort nutzte das israelische Militär laut dem Portal 927 Magazine in den Anfangsmonaten des Krieges für Tausende Angriffe ein KI-System, ohne dass Menschen nennenswert in der Überwachung involviert waren. Dabei wurde wohl das System Lavender verwendet. Dieses könne bei Angriffen unterstützen oder sie gleich eigenständig übernehmen.

In Deutschland arbeiten mehrere Firmen an ähnlichen Systemen, unter anderem Rheinmetall, BWI, Blackned oder Helsing. Auch Hensoldt sowie Airbus Defence and Space sind in diesem Bereich tätig.

Kapitel 3: Verlieren wir die Kontrolle?

Für die deutsche Bundesregierung scheint klar: „Die Einführung von KI-gestützten Waffensystemen ist für die Zukunfts- und Verteidigungsfähigkeit der Streitkräfte notwendig.“ Das schreibt sie in einer Antwort auf eine Kleine Anfrage. Vollständig autonome Waffensysteme jedoch lehne sie jedoch ab.

Es ist zumindest offen, wie lange sie diese Doktrin aufrechterhalten kann. Expertinnen wie Anja Dahlmann vom Institut für Friedensforschung und Sicherheitspolitik an der Universität Hamburg sind diesbezüglich besorgt. Grundsätzlich, sagt Dahlmann, habe sie in dieser Hinsicht Vertrauen in die deutschen Streitkräfte.

„Aber natürlich: Wenn es drauf ankommt, schmeißt man diese Bedenken eher über Bord“, sagt die Expertin gegenüber CORRECTIV. „Dann macht man das so schnell und so autonom und so vorteilhaft für einen selbst wie nötig. Und nimmt eben die rechtlichen, ethischen, Probleme mit in Kauf.“

Die Geschichte zeigt, dass die Bundesregierung durchaus bereit ist, alte Leitlinien bei Bedarf über Bord zu werfen.

CORRECTIV berichtete mehrfach über KI-gestützte Kampfdrohnen, deren Einsatz von der Bundesregierung lange kategorisch ausgeschlossen wurde. In diesem Jahr wurden sie jedoch erstmals für die Bundeswehr bestellt. Die deutschen Firmen Helsing, Stark und Rheinmetall sollen die Brigade in Litauen ab 2027 mit den Drohnen beliefern.

In einem Hintergrundgespräch mit CORRECTIV im Januar räumte einer der Entwickler hinter solchen Systemen ein, dass diese vom Start bis zum Angriff völlig autonom agieren könnten – und schätzt, dass es nur eine Frage der Zeit sei, bis sich die Haltung der Regierung zu einem potenziellen Nutzung ändere.

Auch in der Truppe selbst kommen offenbar Wünsche nach autonom agierenden Waffensystemen auf. Im aktuellen Bericht des Wehrbeauftragten heißt es: „Bewaffnete Drohnen wie auch KI-gestützte und autonom geführte Systeme sind notwendig, um in modernen Konflikten handlungsfähig zu bleiben und die eigenen Kräfte wirksam zu schützen. Sie sind nämlich material- und vor allem personalschonend.“

Laut Expertin Dahlmann ist es ein Problem, dass weder für die breite Öffentlichkeit noch für die Forschung nachvollziehbar ist, wie die KI-Systeme entwickelt werden.

Wer programmiert sie, auf welcher Grundlage? Welche Daten beziehen die Systeme – und woher? Hinzukommt die Frage nach der Verantwortlichkeit, wenn es zu Fehlern kommt.

Schon immer gibt es nur wenig Transparenz bei militärischen Entwicklungen, teils aus guten Gründen. Diese Blackbox, wie Dahlmann sie beschreibt, werde durch KI nur noch schwerer zu durchschauen. Als problematisch erachtet sie auch generative KI, die schon bei rein ziviler Anwendung fehlerbehaftet ist. „Und die sollen jetzt in sicherheitskritischen Bereichen eingesetzt werden, obwohl sie technische Schwierigkeiten mit sich bringen, die man bisher noch nicht gelöst hat – und wo auch völlig unklar ist, wie man sie lösen kann?“

Dahlmann identifiziert ein weiteres Problemfeld: den „krassen Einfluss von privaten Akteuren auf die Technologie“. Tatsächlich sind es grundsätzlich private Unternehmen, die bei KI die Richtung vorgeben – nicht etwa die Regierung oder die Bundeswehr selbst. Ein Umstand, den das Verteidigungsministerium in einem internen Papier selbst einräumt:

„Der künftige Einsatz von KI in der Bundeswehr leitet sich zu einem großen Anteil aus der Adaption von zivilen/kommerziellen Entwicklungen und Anwendungen ab.“ So heißt es in der „Konzeption Künstliche Intelligenz“ von 2022, die CORRECTIV vorliegt. Weiter heißt es: „Neben den klassischen Rüstungsfirmen kommen somit für die Entwicklung und Beschaffung von Wehrmaterial und Ausrüstung für die Bundeswehr künftig noch stärker auch Firmen aus anderen Branchen in Betracht.“

Das Papier wird derzeit offenbar überarbeitet und um eine Roadmap KI ergänzt, um Leitlinien für den Umgang mit neuen autonome Waffensystemen wie Kampfdrohnen zu definieren.

Laut Dahlmann längst überfällig. Aber klar sei auch, dass manche Staaten solche Regularien nicht für sich definieren: „Am Ende wird der Mensch sich an die Geschwindigkeit dieser Entwicklung anpassen müssen.“

Wie solche Leitlinien aussehen könnten, skizziert Frank Sauer von der Bundeswehr-Universität in München: In militärischen Angriffsketten müsse eine sogenannte „meaningful human control“ sichergestellt werden, also eine bedeutsame menschliche Kontrolle. Vorhersehbarkeit, Administrierbarkeit und Zurechenbarkeit; diese Faktoren sollten laut dem Experten auch beim Einsatz von vollautonomen Waffensystemen immer gegeben sein.

„Wenn ich das nicht habe, verliere ich die Kontrolle“, sagt Sauer. Aus seiner Sicht werde diese Sichtweise von den meisten Regierungen weltweit geteilt – wenn auch eher aus Selbstschutz. „Es geht bei dieser Kontrolle natürlich auch um die eigene Sicherheit. Sonst fangen irgendwann Waffensysteme an, aufeinander zu schießen, obwohl wir das nicht wollten.“

Ob der Vorfall um die bombardierte Grundschule im Iran hätte verhindert werden können, wenn ein Mensch bei jedem Schritt der Kill Chain involviert gewesen wäre? Sauer wägt ab. An sich, so sagt er, hätte auch ein Soldat das Ziel anhand veraltetem Kartenmaterial fehldeuten können.

„Wir werden vermutlich nie herausfinden, wo genau der Fehler lag in diesem Zusammenspiel zwischen Mensch und Maschine“, sagt Sauer. „Aber ich vermute, dass er irgendwo in diesem Zwischenraum entstanden ist.“

Redaktion: Anette Dowideit, Lilith Grull

Faktencheck: Lilith Grull

Mitarbeit: Sebastian Haupt (Grafiken), Alexej Hock