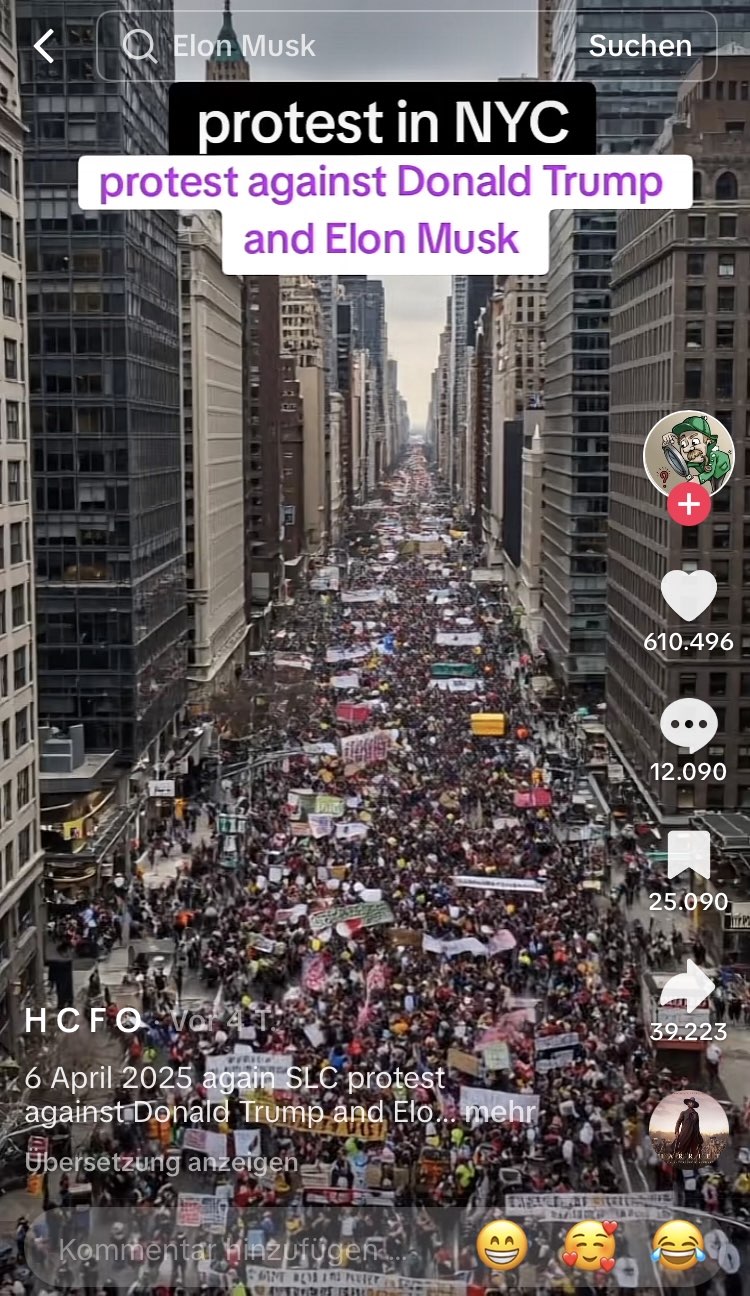

Anti-Trump-Proteste: KI-Video mit falschen Angaben geht auf Tiktok viral

Unter Aufnahmen der Proteste in den USA gegen Präsident Donald Trump mischt sich in Sozialen Netzwerken auch ein Fake-Video. Es ist mit Künstlicher Intelligenz erstellt und ging viral – obwohl es gegen Tiktoks Richtlinien verstößt.

US-Präsident Donald Trump initiierte nach seinem Amtsantritt eine Massenentlassung von Staatsangestellten, entzog einer halben Millionen Migrantinnen und Migranten ihr Aufenthaltsrecht, ordnete die Auflösung des Bildungsministeriums an und verursachte einen Börsencrash.

Gegen seine Politik demonstrierten am 5. April 2025 vielerorts tausende Menschen in den USA. Zu dem landesweiten Aktionstag unter dem Motto „Hands off“ hatte ein Bündnis aus zivilgesellschaftlichen Organisationen in den USA aufgerufen. Die Veranstalter sprachen von Millionen von Teilnehmenden, allein in Atlanta protestierten laut Polizeiangaben über 20.000 Menschen.

Unter die authentischen Foto- und Videoaufnahmen der Proteste mischt sich in diesen Tagen jedoch auch ein KI-generiertes Video. Allein auf Tiktok erreichte es über fünf Millionen Aufrufe und über 600.000 „Gefällt mir“-Angaben, auch auf X und Youtube kursiert es.

Anti-Trump-Proteste in den USA: Virales Tiktok-Video enthält unterschiedliche Ortsangaben

Das KI-Video zeigt zahllose Menschen, die mit Plakaten protestieren – grundsätzlich keine ungewöhnliche Szenerie für eine Demonstration.

Doch die Beschreibung des KI-Videos macht stutzig. Anders als im Text auf dem Video heißt es nicht, der „Hands off“-Protest sei in New York City gewesen, sondern in SLC. Das ist die Abkürzung der Stadt Salt Lake City im US-Bundesstaat Utah, rund 3.200 Kilometer entfernt von New York City.

Neben den zwei unterschiedlichen Ortsangaben heißt es weiter, die Demonstration sei am 6. April gewesen – doch das kann nicht stimmen. Jamie Carter, zuständig für Öffentlichkeitsarbeit bei Demcast – eine der Organisationen, die die „Hands off“-Proteste koordinierten – schreibt uns auf Anfrage: Die Proteste seien alle am 5. April 2025 gewesen. Auch Stichwortsuchen liefern keine Hinweise darauf, dass es in den beiden Städten am 6. April „Hands off“-Proteste gegeben hätte.

Tiktok-Video des Anti-Trump-Protests mit Hilfe von Künstlicher Intelligenz erstellt

Soweit also der Kontext. Doch woran erkennt man, dass das Video nicht echt ist?

Ein genauer Blick auf einen bestimmten Punkt im Video kann dabei helfen. Auffällig sind dann zum Beispiel die Bewegungsabläufe der Personen. Die protestierende Masse scheint in einer schwebenden Bewegung nach vorne zu gleiten. Das wirkt unnatürlich und kann auf eine Bearbeitung mit Künstlicher Intelligenz hindeuten.

Wir haben die Aufnahme Fachleuten gezeigt. Sie verweisen auf weitere Auffälligkeiten, die belegen, dass das Video KI-generiert ist.

Valentin Schwind, Professor für Mensch-Computer-Interaktion an der Frankfurt University of Applied Sciences, schreibt uns: „In der Entfernung verlieren die Fenster beziehungsweise Stockwerke der Gebäude ihre rechten Winkel und scharfen Konturen. Kein einziger Text auf den Transparenten ist lesbar. […] Menschen und Gegenstände […] tauchen aus dem Nichts auf und verschwinden wieder.“

Wir haben die Auffälligkeiten in dem KI-generierten Video farblich (blau, gelb, rot) markiert.

Laut Schwind leide generative Bilderstellung darunter, dass sie Details zwischen Buchstaben nicht so abbilden könne, wie wir das gewohnt seien. Auf diese Auffälligkeiten bei den Transparenten verweist auch Martin Steinebach, Abteilungsleiter für Media Security und IT Forensics am Fraunhofer-Institut für Sichere Informationstechnologie, und zeigt und durch Ausschnitte aus dem KI-Video, wie einzelne Objekte ihre Form verändern.

Andreas Ingerl, Professor für Audiovisuelle Medien an der Hochschule für Technik und Wirtschaft Berlin hat sich das Video für uns gemeinsam mit Studierenden des Studiengangs Kommunikationsdesign angeschaut. Auch er schreibt: „Die Banner glitchen“, die Menschenmenge wirke insgesamt sehr „pixelig“. Das sehe stark nach einer Mechanik aus, um Leerstellen zu füllen.

Verstoß gegen Tiktoks Richtlinien: Video trägt keinen Hinweis auf Künstliche Intelligenz

Trotz eindeutiger KI-Merkmale trägt das Video keinen entsprechenden Hinweis. Laut Tiktoks Community-Richtlinien müssen KI-generierte Inhalte jedoch gekennzeichnet werden. Auf seiner Webseite schreibt der Konzern: „Wir verlangen, dass KI-generierte Inhalte oder bearbeitete Medien, die realistisch wirkende Szenen oder Personen zeigen, gekennzeichnet werden.“

Wir wollten deshalb von Tiktok wissen, warum das KI-Video dennoch millionenfach gesehen werden konnte. Bis zur Veröffentlichung des Artikels erhielten wir darauf keine Antwort. Doch wenige Stunden nach unserer Anfrage wurden das KI-Video sowie der gesamte Tiktok-Account gelöscht.

Es ist nicht das erste Mal, dass versucht wird, mit Hilfe von KI das Bild aktueller Ereignisse anders zu zeichnen.

Wie sich manipulierte Bilder enttarnen lassen:

- Wenn Sie unsicher sind, ob ein Ereignis so stattgefunden hat, wie es auf einem Bild zu sehen ist: Suchen Sie mit Stichworten nach potenziellen Medienberichten zu dem Ereignis.

- Achten Sie, wie oben beschrieben, auf Ungereimtheiten und Details in dem Bild.

- Suchen Sie, wenn möglich, nach der ursprünglichen Quelle für das Bild. Helfen kann dabei manchmal auch eine Bilderrückwärtssuche. Wie die funktioniert, können Sie hier nachlesen.

Redigatur: Max Bernhard, Gabriele Scherndl