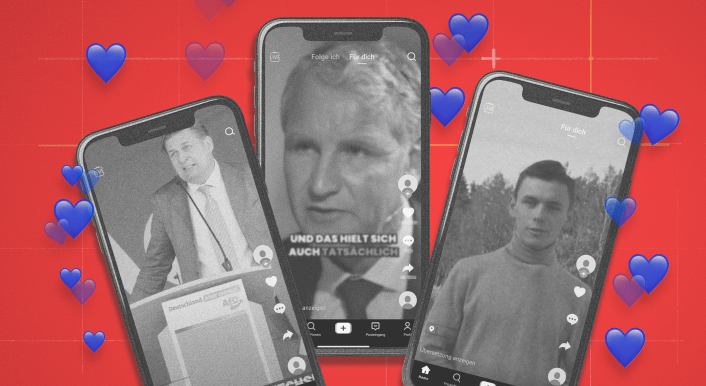

Schöne Lügen: Wie KI-Frauen im großen Stil Meinungsmache für die AfD betreiben

Social Media ist voll mit Profilen angeblicher Frauen, die für die AfD werben und Geld mit Nackt-Inhalten machen. Erst der genaue Blick zeigt: Da ist KI im Spiel. Wie die Maschinerie der künstlichen Stimmungsmache funktioniert, zeigt eine GADMO-Recherche von CORRECTIV.Faktencheck.

Hinweis: In diesem Text geht es um sexualisierte Inhalte.

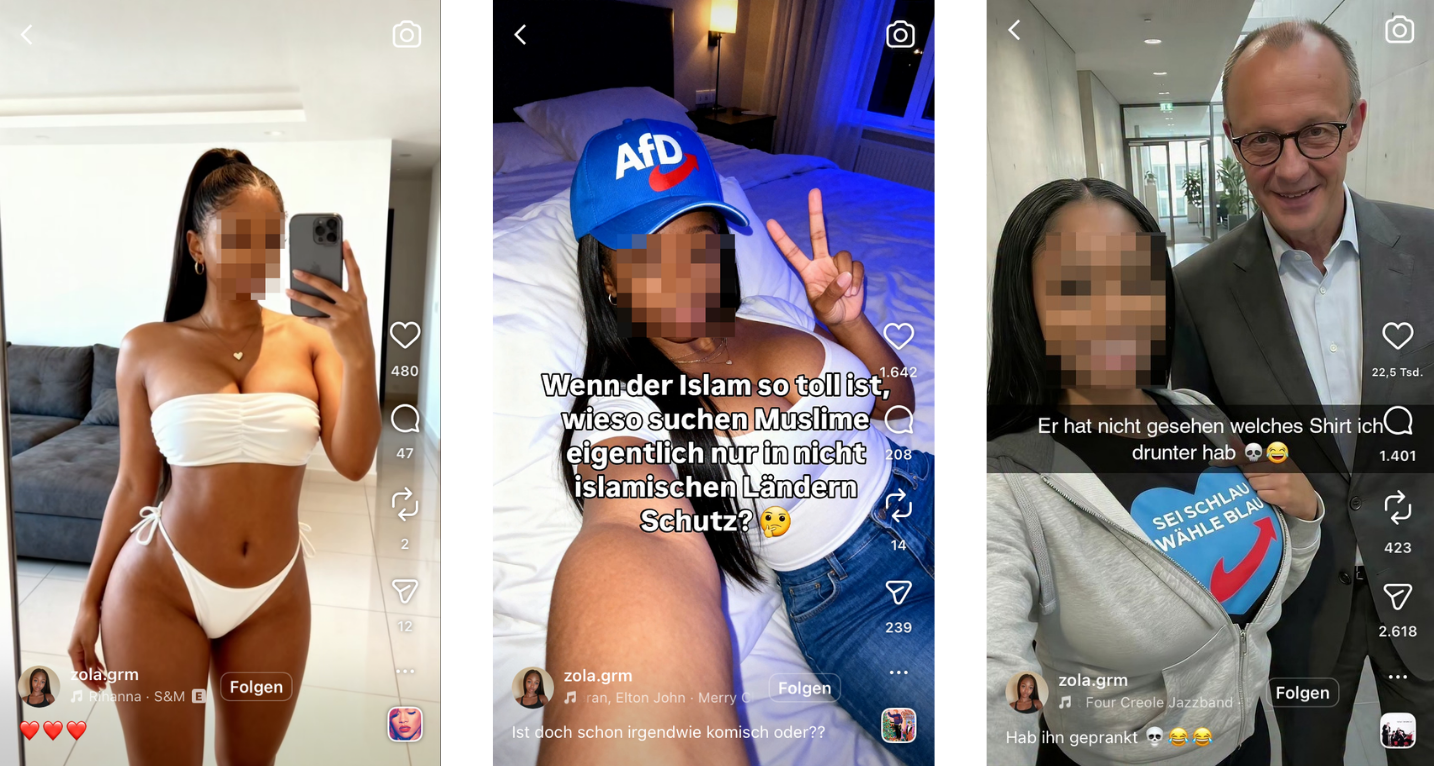

„Ich mag es, gewürgt zu werden“, schreibt Zola auf Instagram. Ein Foto zeigt sie auf dem Beifahrersitz eines Autos, den Körper zur Kamera gedreht, die Arme über den Kopf gehoben. „Aber bitte von einem Deutschen und nicht von einem ‚Einzelfall‘ im Park.“

Zola ist 20 Jahre alt, Single, Krankenschwester und vor zehn Jahren aus dem Senegal nach Deutschland gekommen. Nun wählt sie die AfD und schimpft gegen den Islam, Impfungen und Transpersonen.

Aber: Vieles spricht dafür, dass es Zola gar nicht gibt.

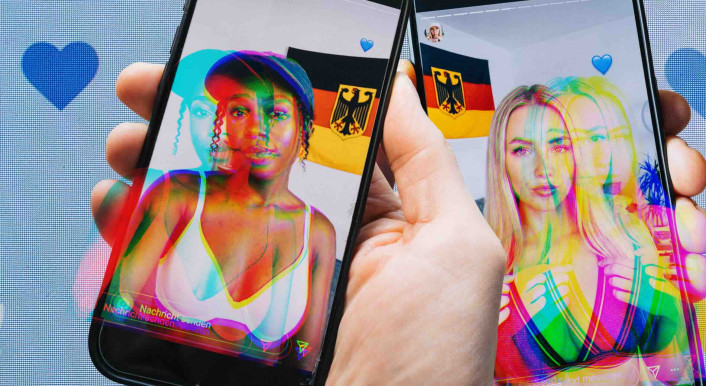

Zola ist nur eine von vielen angeblichen Frauen, die in Sozialen Netzwerken mit viel nackter Haut für die AfD oder rechte bis rechtsextreme Positionen werben – und für ihre eigenen Inhalte auf kostenpflichtigen Plattformen für Erotik-Inhalte. CORRECTIV.Faktencheck fand in einer Recherche für das German-Austrian Digital Media Observatory (GADMO) rund 190 Profile von 22 angeblichen Frauen, die auf Tiktok, Instagram, Facebook und Threads Millionen erreichen.

Was viele Nutzer nicht erkennen: Einige der Bilder und Videos sind mit Künstlicher Intelligenz bearbeitet, wenn nicht sogar komplett KI-generiert, aber größtenteils nicht als solche gekennzeichnet. Die Verantwortlichen hinter den KI-Personas nutzen damit Taktiken, die auf Social-Media-Plattformen eigentlich verboten sind.

In dieser Recherche zeigen wir, wie damit eine Meinungsmaschine aufgebaut wird, nach welchem Schema die Inhalte funktionieren und welche Auswirkungen das auf die politische Debatte haben kann.

KI-Inhalte, Erotik-Plattformen und die AfD: Wie das „System Zola“ funktioniert

Zola ist ein besonders erfolgreiches Beispiel für die Masche. Da ist vermeintlich eine junge Frau, die mal vor dem Spiegel posiert, mal knallharte rechte Sprüche oder Wahlaufrufe für die AfD teilt, dazwischen explizit sexualisierte Inhalte. Sie wird als Influencerin präsentiert, die AfD-Chefin Alice Weidel und den Thüringer AfD-Landeschef Björn Höcke getroffen und Bundeskanzler Friedrich Merz zur Schau gestellt haben will. Auf Nachfrage schreibt zumindest das Büro von Merz, die Fotos mit ihm seien nicht echt, die AfD-Büros antworten nicht.

Zolas Inhalte kommen an. Nutzer kommentieren unter den Beiträge etwa: „Das ist das genau richtige Statement. Bravo“ oder „Hast du Interesse an einem echten Kennenlernen?“

Zola wirbt aber nicht nur für die AfD, sondern auch für ihr Profil auf Fanvue, eine Plattform ähnlich wie Onlyfans. Nutzer können dort für erotische Inhalte bezahlen – im Fall von Zola gut 12 Euro pro Monat. Dort steht in der Profilbeschreibung etwas, das auf Instagram nicht steht: „KI-generiert oder -verbessert“.

Fotos der Beiträge von Zola weisen KI-Merkmale auf

Schon mit bloßem Auge fallen Unstimmigkeiten zwischen Bildern auf. Zum Beispiel unterscheiden sich Details in ihrer Wohnung auf den unterschiedlichen Fotos: Mal hat ihre Mikrowelle ein Tastenfeld, mal nicht. Und obwohl Zola angeblich in Deutschland lebt, hat sie keine Steckdosen, wie sie in Deutschland üblich sind. In einem Video scheinen Teile ihrer Augen zu verrutschen, in einem anderen verformen sich ihre Hände. Darüber hinaus schlagen auch mehrere Tools, die KI-Inhalte aufspüren, bei Inhalten von Zola an.

Wir haben keine Hinweise dafür gefunden, dass Zola eine echte Person mit diesem Namen und Aussehen ist. Wir wissen jedoch nicht, ob die gesamte Figur von einer KI konstruiert wurde, oder ob reale Aufnahmen manipuliert wurden.

Unsere Tools und Methoden für die KI-Analyse

Anwendungen, die KI-generierte Inhalte erkennen, sind nicht zu hundert Prozent zuverlässig und nicht für jede Art von Material geeignet.

Für diese Recherche haben wir deshalb auf eine Kombination aus drei Online-Tools und eigener Recherche gesetzt: Die Media Intelligence Plattform des Austrian Institute of Technology, das gemeinsam mit CORRECTIV.Faktencheck Partner des German-Austrian Digital Media Observatory (GADMO) ist. Der Imagewhisperer, eine Entwicklung des niederländischen Datenexperten Henk van Ess und Gemini, die KI-Anwendung von Google, die erkennen kann, ob Inhalte ein digitales Wasserzeichen enthalten. Die eigene Recherche umfasste sichtbare Logikfehler.

Zu dem Urteil, dass eine Persona KI einsetzt, kamen wir, wenn mindestens zwei dieser Anwendungen im selben Beitrag KI-Nutzung erkannten und wir in mindestens einem Beitrag optische Fehler fanden.

Bei allen 22 Personas war das der Fall. Gleichzeitig bewerteten die Anwendungen bei einem Teil der Profile einzelne Social-Media-Beiträge wiederum als authentisch. Es ist also naheliegend, dass die Profile sowohl mit echten, als auch mit manipulierten und komplett KI-generierten Inhalten arbeiten.

Das deckt sich mit Analysen von Vera Schmitt und Max Upravitelev von der TU Berlin – die beiden analysierten auf Anfrage von CORRECTIV.Faktencheck einen Teil der Profile und fanden ebenfalls zahlreiche Hinweise auf KI-Einsatz. Die Aufnahmen seien teils mit unterschiedlichen KI-Modellen erstellt worden.

Für alle Profile gilt: Sie nutzen KI für ihre Bilder oder Videos, doch je nach Profil werden mal mehr und mal weniger KI-Bilder und -Videos eingesetzt. Möglich ist, dass manche der KI-Personas komplett erfunden sind, während andere mit teilweise echtem Material arbeiten. Weil denkbar ist, dass für die Fakes Fotos von echten Frauen gestohlen wurden, haben wir uns entschieden, die Gesichter in den Bildern zu pixeln.

Haben Sie Hinweise zu dieser Recherche oder erkennen Sie die Inhalte der KI-Frauen wieder? Melden Sie sich unter faktencheck@correctiv.org.

Sex sells: Erst in der MAGA-Bewegung, nun in der AfD-Fangemeinde

Über KI-Personas wie Zola wurde vereinzelt bereits berichtet: In den USA ging Jessica Foster viral, eine angebliche Trump-Unterstützerin, ebenfalls KI und Onlyfans-Betreiberin. Besonders bekannt, aber weitgehend unpolitisch, ist Emilia Pellegrini. Laut Berichten steht hinter Pellegrini ein Mann, der Kurse für das Kreieren von KI-generierten Influencerinnen anbietet. Tutorials dafür gibt es auch auf Deutsch. Und hinter einer weiteren KI-MAGA-Influencerin steckte laut Wired ein Medizinstudent aus Nordindien, der „superdumme Männer“ abzocken wollte.

In Deutschland griff vor kurzem Belltower das Phänomen erstmals auf und berichtete über drei AfD-nahe KI-Profile, die für Erotik-Inhalte werben. Auch bei APA, DPA und AFP schlugen bereits einzelne Aufnahmen auf, die drei Nachrichtenagenturen sind, ebenso wie CORRECTIV.Faktencheck, Partner im Netzwerk GADMO.

Doch das Ausmaß ist deutlich größer als bisher bekannt.

Da gibt es zum Beispiel Luisa, die zwar erst 19 sein soll, aber Interesse an Männern im Alter von 36 bis 86, gerne mit Bierbauch, habe. Bilder auf ihrem Profil wirken teils echt, andere Beiträge sind offensichtlich KI-generiert. Oder Nina, die auf Tiktok mal als Netto-Mitarbeiterin, mal als Kfz-Mechanikerin auftritt. In der Werkstatt hängen Schilder mit KI-typischen Nonsense-Wörtern drauf. Oder Bella, besonders gut als KI zu erkennen, die auf Instagram-Bildern meist an Ständen der AfD steht und zwischendurch gleich auf zwei Erotik-Plattformen Bilder verkaufte.

CORRECTIV.Faktencheck fand insgesamt rund 190 Profile von 22 angeblichen Frauen, die gemeinsam Millionen erreichen. Sie alle führen zu Erotik-Plattformen, sind rechts und arbeiten mit KI.

Mehr zur Datenanalyse von CORRECTIV.Faktencheck

CORRECTIV.Faktencheck führt täglich ein Monitoring durch, um irreführende Informationen in Sozialen Netzwerken zu identifizieren. Dabei fanden wir einen viralen Tiktok-Beitrag von Zola.

Davon ausgehend identifizierten wir anhand von wortgleichen Beitragstexten insgesamt 22 Personas, die dieselbe Masche verwenden: Sie nutzen für ihre Social-Media-Profile Künstliche Intelligenz oder sind komplett KI-generiert, verwenden aber in den allermeisten Fällen keinen entsprechenden Transparenzhinweis. Sie teilen rechte oder rechtsextreme Positionen oder werben für die AfD, indem sie das blaue Herz-Emoji nutzen oder die Partei explizit in ihren Beiträgen nennen und sie alle verlinken auf kostenpflichtige Erotik-Plattformen.

Die 22 Personas betreiben teils mehrere Accounts auf unterschiedlichen Plattformen. Durch eine manuelle Suche nach Nutzernamen, Followern und Kommentaren konnten wir 188 Profile ausmachen. Die Liste erhebt keinen Anspruch auf Vollständigkeit.

Wie arbeiten die Profile zusammen?

Teilweise sind die Personas und Profile untereinander vernetzt. So kommentiert Bella bei Zola, Zola folgt Luisa und Luisa folgt gleich zwei verschiedenen Profilen von sich selbst.

Besonders auffällig sind Überschneidungen in den Inhalten. Teilweise veröffentlichen die Profile wortgleiche Beiträge. Zum Beispiel schreiben verschiedene Profile in zehn Beiträgen über sich selbst: „Vielleicht nicht die Schönste, aber rechts“. Sogar dieselben Rechtschreibfehler finden sich in den Beiträgen.

Zwölf Profile fragen: „Wenn der Islam so toll ist, warum suchen dann Muslime eigentlich nur in nicht islamischen Ländern Schutz?“ (Diese Behauptung hat CORRECTIV.Faktencheck 2025 widerlegt.) Und drei angebliche Frauen schreiben teils in mehreren Beiträgen, ihnen würden nur deutsche Männer ins Bett kommen.

Zwei Beiträge von Zola und einer Persona namens Nala haben nicht nur denselben Text, die Personas haben sogar dieselbe Kleidung an und sitzen in exakt der gleichen Position auf einem identischen Bett.

Zwei andere Beiträge zeigen jeweils dasselbe Zimmer, aber darin eine andere Frau.

Das, was die KI-Personas veröffentlichen, übersteigt in vielen Fällen deutlich, was man von herkömmlicher Social-Media-Nutzung erwartet. So gibt es unter dem Namen Zolas nicht nur ein Instagram- und ein Threads-Konto, sondern mindestens 20 weitere Profile auf Tiktok, die teils wiederum auf unterschiedliche Telegram-Accounts verweisen. Außerdem wechselten mehrere Profile im Laufe der Zeit ihren Namen oder ihre Bilder.

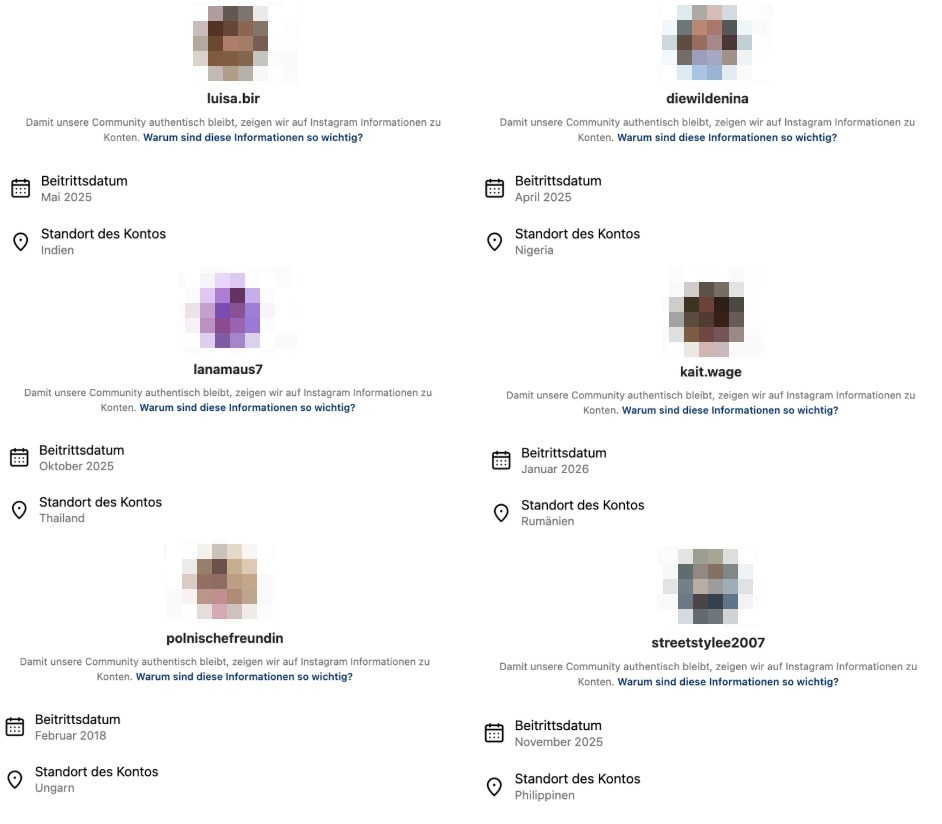

Auffällig ist auch: Nicht alle Profile werden aus Deutschland bespielt. Wir fanden zwei Dutzend Profile, die laut den Standortangaben der Plattformen in Rumänien oder Ungarn, in Thailand, Indien oder auf den Philippinen betrieben werden.

Dann gibt es da noch zwei Profile, die aussehen und heißen wie Zola. Dort heißt es, sie lebe angeblich in Texas. Diese Profile wiederum werden aus Deutschland betrieben.

Beiträge der KI-Frauen verstoßen gegen Plattform-Richtlinien

Schaut man sich die Richtlinien der Social-Media-Plattformen an, dann dürfte es diese Bilder und politische Meinungsmache so nicht geben. Tiktok schreibt vor, dass „KI-generierte oder erheblich bearbeitete Inhalte, die realistisch wirkende Szenen oder Personen zeigen“ entsprechend gekennzeichnet werden müssen. Zudem erlaubt Tiktok nicht, dass mehrere Profile eingerichtet werden, „um andere zu täuschen“.

Ähnlich lauten die Richtlinien des Meta-Konzerns, also für Facebook, Instagram und Threads. Auf den Plattformen müssen fotorealistische Videos und realistisch klingende Audiospuren als KI gekennzeichnet sein, nicht aber Bilder. Die „Falschdarstellung einer Identität“, um andere in die Irre zu führen oder zu täuschen, verstößt gegen die Richtlinien, genauso wie „die sexuell motivierte Kontaktaufnahme“: zum Beispiel, indem auf Kontaktmöglichkeiten verwiesen wird, um Nacktfotos zu teilen.

Wir haben die Plattformen auf die Profile der KI-Frauen hingewiesen. Wir wollten wissen, weshalb sie Millionen Aufrufe erreichen, obwohl sie teils gleich gegen mehrere Plattform-Richtlinien verstoßen. Tiktok reagierte nicht auf unsere Anfrage, Meta antwortete, ging jedoch nicht auf unsere konkreten Fragen ein.

Nach unserer Anfrage an die Plattformen verschwanden 14 von 18 beispielhaft mitgeschickten Profilen. Auch ein reichweitenstarkes Instagram-Profil von Zola ist mittlerweile gelöscht. 25 weitere Profile verschwanden im Laufe der Recherche. Damit sind immer noch über 140 Profile aus der Stichprobe weiterhin aktiv (Stand: 27. April 2026).

„Einzigartiger KI-Müll“ und „fiktive Hintergründe“

Wer hinter den Konten steht, ist unklar. Wir haben alle Personas, bei denen das möglich war, angeschrieben, bekamen jedoch nur von zweien eine Antwort.

Ein Profil gibt an, sie sei wirklich die Person, die in ihrem Profil zu sehen ist. Angesprochen darauf, dass in einem ihrer Beiträge offensichtlich KI verwendet wurde, schreibt sie, sie habe mit einem „fiktiven Hintergrund“ experimentiert. Mittlerweile ist der Beitrag gelöscht. Sie schreibt auch: „Mit anderen Profilen stehe ich weder im Austausch noch kenne ich diese Personen.“

Ein anderes Profil schreibt lediglich: „Mein KI-Müll ist einzigartig“.

Laut Anna Hiller vom Institute for Strategic Dialogue ist es „schwer zu sagen, ob die Profile als Absicht haben, Werbung für die AfD zu machen oder eher ein Köder sind, um Leute, die mit dem rechten Spektrum sympathisieren, auf Bezahl-Websites wie Onlyfans zu locken“. Hiller hat dazu geforscht, wie rechtsextreme Akteure generative KI in ihre Social-Media-Strategien integrieren und sagt: Ein Teil der Inhalte habe Ähnlichkeiten zu den von ihr analysierten Beiträgen rechtsextremer Akteure.

Das deckt sich mit anderen Einschätzungen. „Die Accounts operieren offenbar im gleichen Milieu und haben voneinander Kenntnis. Eine koordinierte Kampagne lässt sich auf Basis der vorliegenden Daten jedoch nicht nachweisen“, schreiben Vera Schmitt und Max Upravitelev von der TU Berlin, die auf Anfrage von CORRECTIV.Faktencheck einen Teil der Profile analysiert hatten.

Fest steht: Alle Personas in unserem Datensatz bedienen sich derselben Masche. So erschaffen sie gemeinsam die Illusion einer Menge junger Frauen mit unterschiedlichen Geschichten, Körperformen und Hautfarben, die hinter rechten bis rechtsextremen Positionen oder der AfD stehen. Frauen, die sowohl als unterwürfig als auch auf ihren Körper fixiert dargestellt werden. Damit, so sagt Eva Berendsen, Politikwissenschaftlerin an der Bildungsstätte Anne Frank, die zu Künstlicher Intelligenz und auch zu Geschlechterpolitik publizierte, tragen sie zur Normalisierung dieser Botschaften bei: „Junge Menschen gewöhnen sich daran, so wie wenn dauernd irgendwo ein Hakenkreuz stehen würde“.

So manchen Nutzer scheint es dabei nicht zu kümmern, ob die Frauen echt sind, oder nicht, solange sie das eigene Weltbild bestärken. Ein Kommentar unter einem Beitrag von Zola bringt es auf den Punkt: „Denke, es ist bearbeitet, aber trotzdem gut“.

Transparenzhinweis: CORRECTIV ist seit 2017 in einer Kooperation mit dem Facebook-Konzern Meta, um Desinformation auf dem Sozialen Netzwerk zu bekämpfen. Mehr Informationen zu der Kooperation erhalten Sie hier.

Redigatur: Steffen Kutzner, Sara Pichireddu

Datenanalyse: Johannes Gille

Datengrafik: Sara Pichireddu

Mitarbeit: Laura Seime

CORRECTIV im Postfach

Lesen Sie von Macht und Missbrauch. Aber auch von Menschen und Momenten, die zeigen, dass wir es als Gesellschaft besser können. Täglich im CORRECTIV Spotlight.

Mit der Anmeldung willigen Sie der Verarbeitung Ihrer Daten gemäß unserer Datenschutzerklärung ein.