Wie wir Wolf Schneider klonten

Das größte Versprechen von künstlicher Intelligenz: Sie kann menschliche Intelligenz unsterblich machen.

Nur wieder eine „Revolution“, die uns für ein paar Wochen in Aufregung versetzt? Oder etwas, was die Grundlagen unserer Kommunikation verändert wie nichts davor? Wir wollten es genauer wissen.

Vor einem Jahr fingen wir an, künstliche Intelligenz systematisch und praxisnah daraufhin zu überprüfen, ob und wie sie uns wirklich helfen kann, Texte zu verbessern. In den folgenden Monaten entwickelte sich daraus eine Expedition in Sphären des Unerwarteten, die mit keiner Erfahrung meiner langen journalistischen Arbeit zu vergleichen ist.

Begonnen hat es mit einer Beerdigung, auf dem Waldfriedhof in Strausberg.

Ein Nachruf müsse zu 51 Prozent aus Lob bestehen, sagte der Sohn in seiner Trauerrede, als der Vater beerdigt wurde. Sein Enkel zitierte auf der Trauerfeier aus Kommentaren, die junge TikTok–User dem Verstorbenen unter dessen Tutorials gesetzt hatten: „Wie traurig, mach’s gut, großer Mann!“ und „Seine Weisheiten werden weiterleben“. Wolf Schneider war mein Lehrer an der Journalistenschule, seine Weisheiten begleiten mich durchs halbe Leben: Mit Silben geizen, Synonyme tilgen, Nominalkonstruktionen zerschlagen, all diese harschen Befehle im mutigen Kampf gegen erbrochenes Deutsch. Und natürliche Ratschläge wie: Niemals als Journalist im T-Shirt zum Interview, das ist ein Unterhemd!

Die begeisterten, trauernden TikTok-User, überwiegend im Ur-Enkel-Alter, lobten Wolf Schneider, weil er in den Wochen vor seinem Tod in 24 kurzen Videos zu ihnen über das gesprochen hatte, was sie in der Schule offenbar nicht gehört hatten: Wie man gut schreibt. Schneider ging, ChatGPT kam, im selben Monat. Auf glückliche Weise kreuzten sich beide Lebenswege in meinem Hirn. Schneider war eine Wissensmaschine, ein nimmermüder Sammler von Dit und Dat. Titanic, Alpen, Neandertaler, Kölner Dom, Soldat, Lüge, Babylon, Glück – alles Bücher von Schneider, die er sich zusammengesammelt hatte. Jahrelang Schnipsel in beschriftete Klarsicht-Hüllen sortiert, in seinem Hirn zusammen gerührt zu schlüssigen Texten, die er alle paar Jahre als Bücher ausspuckte. „Deutsch für Profis“, „Deutsch fürs Leben“ und acht andere Bücher über das Schreiben kommen natürlich dazu. Schneider war die menschgewordene KI, ein Mensch, der ChatGPT hätte zeugen können, wenn das möglich wäre. Darum überraschte es mich nicht, dass ich bald auf den Gedanken kam, ChatGPT mit Wolf Schneider zu konfrontieren. Zu meiner Überraschung spulte ChatGPT die 50 wichtigsten Wolf-Schneider-Regeln für gute Texte herunter, als würde das Ding sie jeden Tag beherzigen. Da waren sie wieder: Deutsche Syntax überlisten! Passiv, Infinitiv, Plusquamperfekt vermeiden! Alle sieben Satzzeichen verwenden! All die Gebote und Verbote für elegantes Deutsch. Ich bat ChatGPT, einen Absatz aus dem Roman, den ich gerade schreibe, nach Schneiders Regeln zu redigieren. Das Ergebnis war erschütternd, er verkitschte die Begegnung zwischen einem westdeutschen Linksradikalen, der LSD schluckt, und einem ostdeutschen Mädchen, deren Vater ein Stasi-Oberst im Westeinsatz ist. Gut, als Romancier war Wolf Schneider nie aufgefallen; was aber, wenn man seine Regeln nutzt, um journalistische Texte von künstlicher Intelligenz in seinem Stil redigieren zu lassen? Ich fragte meinen neuen KI-Coach, den ich inzwischen kumpelig „Chat“ nannte. Seine Antwort: „Wolf Schneider ist bekannt für seine Regeln und Prinzipien für gutes Deutsch. Seine Anleitungen, wie man klarer und ansprechender schreibt, sind seit Jahren beliebt und werden von vielen geschätzt. Die Idee, seine Schreibregeln in ein KI-Tool zu integrieren, um Menschen zu helfen, bessere Texte zu schreiben, klingt vielversprechend.“ Klang nicht begeistert, eher höflich. Aber schnell merkte ich, dass Chat ein sehr strukturierter Kopf ist, er pflegt so hilfreich und umfassend zu antworten wie Wolf Schneider: Das Vielversprechende an der Idee seien die „automatisierte Feedback-Schleife“, die „Skalierung“, „Anpassungsfähigkeit“ und „interaktives Lernen“; zu beachten seien allerdings die „Komplexität der deutschen Sprache“, „unterschiedliche Sprachstile“, „Datenschutz“ und „Lizenzfragen“. Wolf Schneider auf ChatGPT loszulassen, gefiel meinen Kolleginnen und Kollegen in der Reporterfabrik, der Webakademie für Journalismus; und da wir Geldgeber (CORRECTIV) und in Benedikt Falkenstein (neopalm) einen begeisterungsfähigen Entwickler fanden, machten wir uns ans Entwickeln. Wolf Schneider hat uns bei der fünfmonatigen Entwicklung seiner KI über die Schulter geschaut: Vor 35 Jahren hatte er in die Zukunft geblickt und vorausgesehen, dass eines Tages Stilprogramme Redakteuren das Leben leichter machen werden: „Der Verfasser einer Stilkunde ist naheliegenderweise ein Mensch von ausgeprägt lehrhafter Gesinnung und leugnet nicht, dass diese Vision etwas Faszinierendes hat.“ Seine Schreckensvision: „Uns allen graust vermutlich bei der Vorstellung, Stilregeln könnten einem hochgezüchteten elektronischen Idioten zum Zweck der Erzwingung eingegeben werden.“ Sein Rat: Der schreibende Mensch müsse die Freiheit behalten, seinen Stil zu ändern, Empfehlungen und Warnungen zu beherzigen oder nicht.

Die große Frage, die uns deshalb geleitet hat: Wie können Maschinen von Menschen lernen, die menschliche Sprache besser zu beherrschen als Menschen; wie können elektronische Idioten die Intelligenz von Wolf Schneider zu künstlicher Intelligenz umformen, die von nun an Texte so redigiert, wie er es getan hätte. Wir brauchen ChatGPT als Basis dieser Freiheit; Chat lotst uns durch die Regularien seines Headquarters OpenAI: Erst sich bei OpenAI registrieren lassen, über eine Programmierschnittstelle (API) auf die Dienste zugreifen, über die API die Texte der User plus Anweisungen an ChatGPT leiten. Diese „Anweisungen“ sind das Wichtigste, es sind die „Prompts“, die den Rechnern von OpenAI befehlen, wie sie die Texte redigieren sollen. In unserem Fall sind es die 50 Regeln, mit denen Wolf Schneider die Sprache klarer, unbürokratischer, anschaulicher und das Satzgefüge übersichtlicher macht. Fragen wir Chat, der wissen muss, wie er klüger wurde. Er? Natürlich kann Chat auch ein „sie“ oder „es“ sein; Chat behauptet, eine Maschine ohne Geschlecht und Selbstbewusstsein zu sein. „Ich wurde durch einen Prozess trainiert, der supervised learning und reinforcement learning umfasste.“ Das ist ein typischer ChatGPT-Satz, ich lerne schnell, ihn zu einem Deutsch zu zwingen, das ein zehnjähriges Kind versteht. Er spricht zum Kind in mir: „Stell dir vor, du lernst Fahrrad zu fahren und jemand (z.B. ein Elternteil) läuft die ganze Zeit neben dir her. Jedes Mal, wenn du zu stark lenkst, sagen sie: „Nicht so stark lenken!“ Und wenn du nicht genug in die Pedale trittst, sagen sie: „Tritt stärker!“ Diese Person gibt dir genaue Anweisungen darüber, was du in jedem Moment tun sollst. Sie „überwachen“ dich und zeigen dir den richtigen Weg.“ Das sei supervised learning. Reinforcement Learning müsse man sich so vorstellen: „Niemand gibt dir genaue Anweisungen. Stattdessen bekommst du jedes Mal, wenn du ohne Fallen eine bestimmte Strecke schaffst, eine Belohnung von deinen Eltern. Aber wenn du fällst, gibt es keine Belohnung und du tust dir weh.“ Natürlich sollte jeder Mensch die Selbstauskünfte der Maschine überprüfen, da nicht klar ist, mit welchen Texten die KI gefüttert wurde. Es waren 570 Gigabyte Textdaten aus dem Internet, die eine Vielzahl von Themen, Stilen und Schreibweisen abdecken, also Websites, Wikipedia-Einträge, Bücher, Textsammlungen wie das Gutenberg-Projekt. Wie viel Buchseiten sind das, Chat? Mal sagt er 228 Millionen Buchseiten, mal 280 Millionen Buchseiten. Die gesammelten Textdaten wurden vorverarbeitet, um unerwünschte Informationen zu entfernen, wie zum Beispiel persönliche Daten oder andere sensible Informationen. „Für ChatGPT wurde ein neuronales Netz trainiert, das auf GPT-3 basiert.“ Dieses neuronale Netzwerk hat viele Schichten von Neuronen, die miteinander verbunden sind. Es lernt, Muster und Zusammenhänge in den Daten zu erkennen.“ Stopp! Wie entsteht dieses neuronale Netzwerk in dir? „Ein neuronales Netzwerk ist ein Modell in der Informatik, das von der Arbeitsweise menschlicher Gehirnzellen, den Neuronen, inspiriert ist.“ Es handele sich dabei um Algorithmen, die Muster erkennen können. Diese Mustererkennung werde durch „Training“ auf Daten erreicht. Chat erklärt dann etwas langatmig, was Neuronen sind, warum sie in Schichten angeordnet sind, wie sie miteinander funktionieren. Und klärt bescheiden auf: „Es ist wichtig zu betonen, dass meine neuronalen Netzwerke, obwohl sie beeindruckende Fähigkeiten in bestimmten Aufgabenbereichen haben, nicht in der Lage sind, „intuitiv“ zu denken oder echtes Verständnis im menschlichen Sinne zu haben. Ihre „Entscheidungen“ basieren auf der Analyse von Daten und der Anwendung von erlernten Mustern, nicht auf Gefühlen, Intuition oder Bewusstsein.“ Die KI versteht die Wörter und Silben, die ihr trillionenfach eingegeben werden, zunächst so wenig wie ein Baby, das Laute, Silben, Wörter nachplappert. Die künstliche Intelligenz vergleicht ihren Lernprozess mit der Annäherung eines Babys an die Sprache – erste Erkenntnis bei der Menschwerdung der künstlichen Intelligenz (der KI-Werdung Wolf Schneiders). Wir Menschen bringen der Maschine unsere Sprache bei, um uns mit ihr unterhalten zu können wie mit einem Menschen. Auch unser Wolf-Schneider-Experiment, das lernen wir schnell, nutzt der Computer, um eleganter mit unserer Sprache umzugehen. Das freut uns, das nutzen wir, das sollen zukünftig Zehntausende nutzen. Großartig. Großartig? Sprache ist das Privileg der menschlichen Zivilisation, komplexe Sprache ist der Schlüssel zu dem, was den Menschen vom Tier unterscheidet – und bisher auch von der Maschine. Wir bringen der KI unsere Sprache bei, was macht sie damit? Es gibt viele, die das ängstigt, weil wir einer außermenschlichen Existenz das exklusive Werkzeug übereignen, menschliches Denken zu beeinflussen.

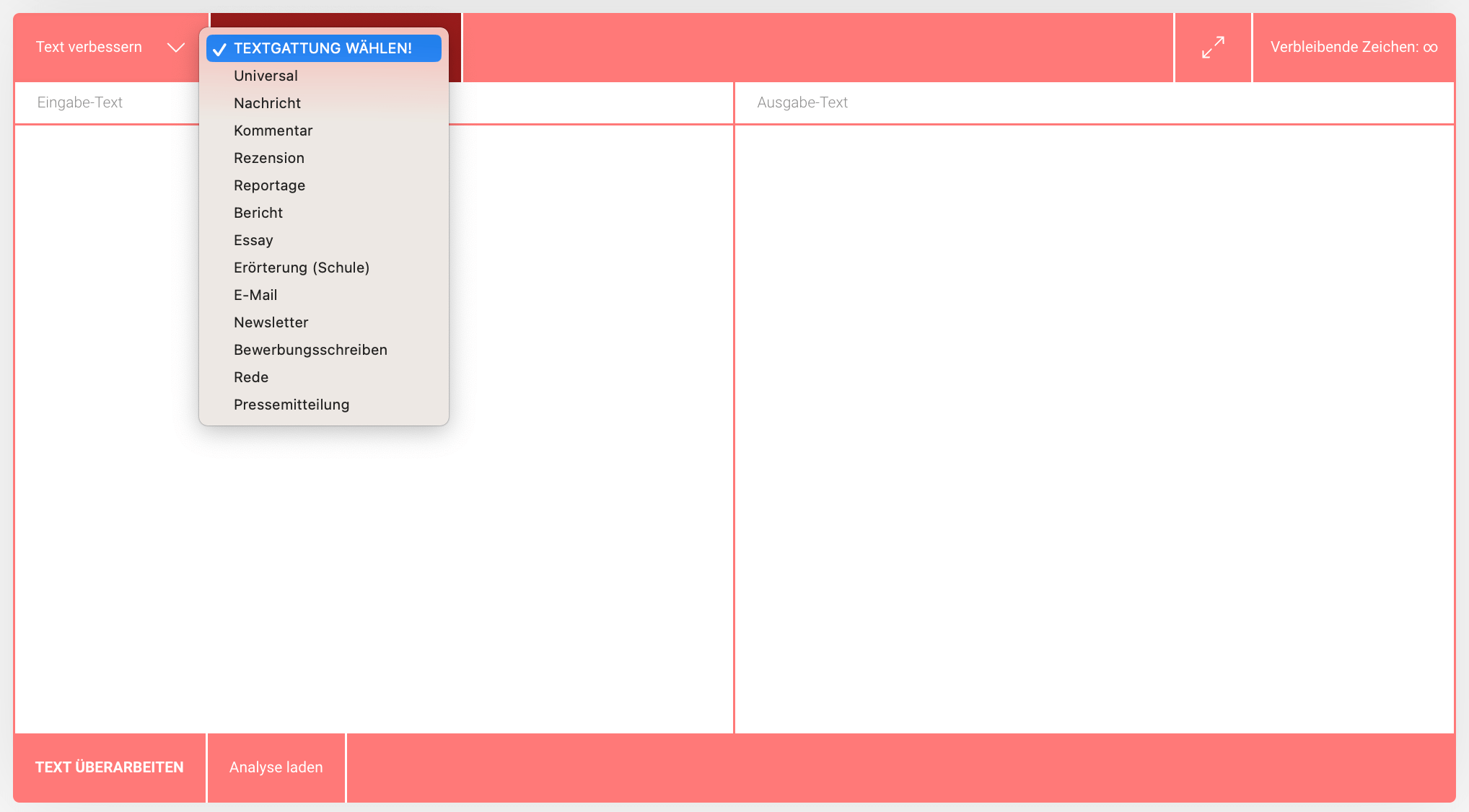

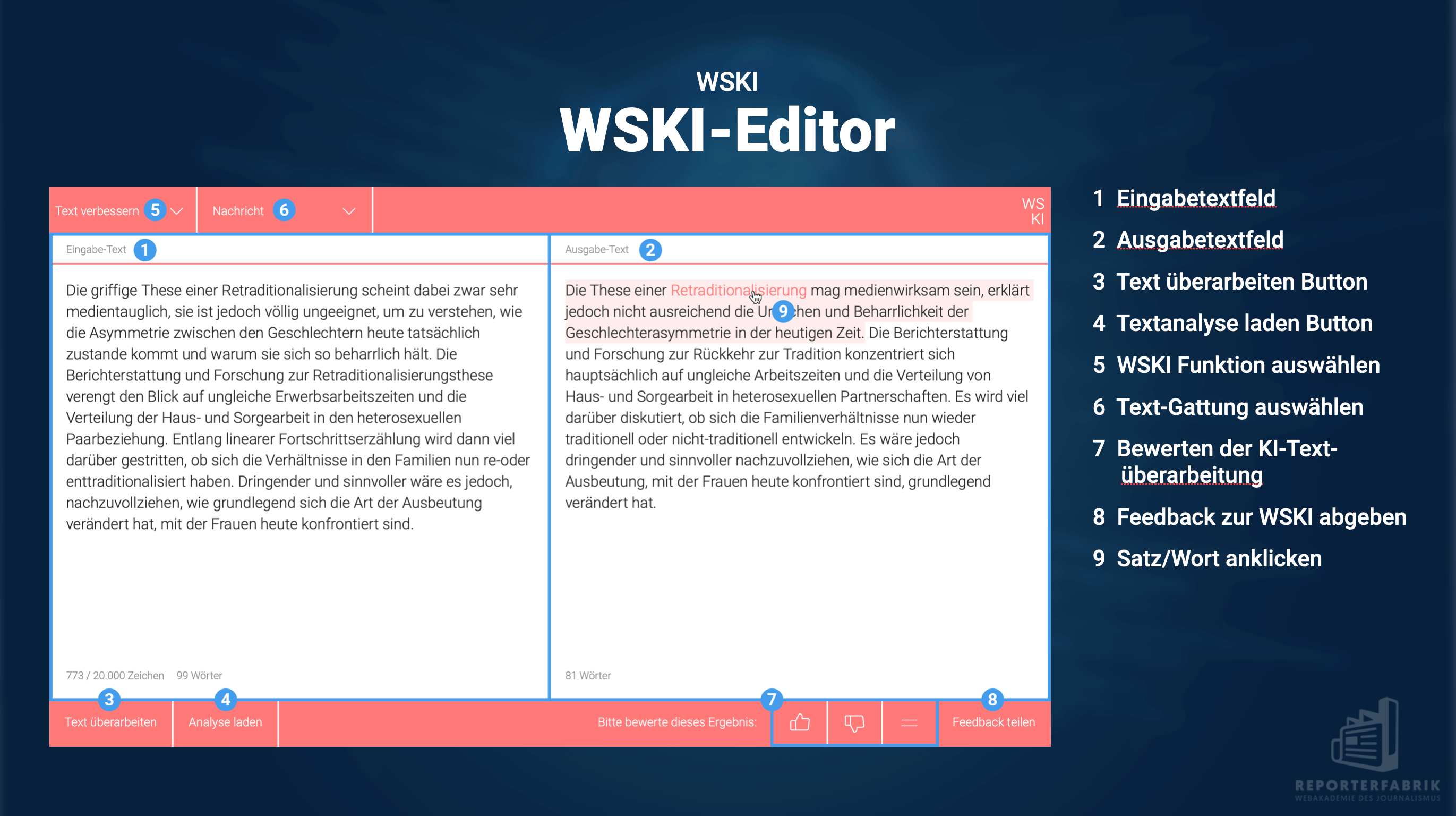

Jetzt aber mal konkret, Chat: „Wenn ich dir den Prompt eingebe, verwende Verben anstelle von Nominalkonstruktionen und ich füge als Beispiel den Satz hinzu: „Durch die Verhaftung des Bürgermeisters kam Bewegung in die Art und Weise der Zusammenarbeit zwischen den Parteien und führte zu einer Überprüfung der Regierungsarbeit.“ Was passiert dann in deinen neuronalen Netzen, wie baust du den Satz um, und warum? Chat antwortet: „Wenn du mir den Prompt und den Satz gibst, wird mein neuronales Netzwerk eine Reihe von Prozessen durchlaufen, um die Anforderung zu erfüllen.“ Sein Modell erkenne, dass ich eine Stiländerung möchte, bei der Nominalkonstruktionen durch Verben ersetzt werden sollen. „Während des Durchlaufs durch das Netzwerk wird das Modell Muster und Strukturen innerhalb des Satzes erkennen, die es in seiner Trainingsdatenbank gesehen hat.“ Es identifiziere Nominalkonstruktionen, die potenziell durch Verben ersetzt werden können. „Das Modell verwendet die gelernten Muster, um den Satz umzuformulieren und den gewünschten Stil zu erreichen. Nach der Transformation generiert das Modell einen neuen Satz, der deinen Anweisungen entspricht.“ Er lautet: „Der Bürgermeister wurde verhaftet, was die Zusammenarbeit zwischen den Parteien belebte und eine Überprüfung der Regierungstätigkeit veranlasste.“ Das Ganze dauert 1.5 Sekunden. Die wirkliche Magie, so Chat, liege in der Fähigkeit des Modells, Muster aus riesigen Mengen von Daten zu lernen und diese Muster anzuwenden, um komplexe Aufgaben wie das Umschreiben von Sätzen zu erfüllen. Von „Magie“ spricht das Ding, hat allerdings was übersehen: die Nominalkonstruktionen „Überprüfung“ und „Regierungsarbeit“ hat sie nicht durch Verben ersetzt. „Entschuldigung, das war mein Fehler. Lass mich den Satz erneut umformulieren: ‚Der Bürgermeister wurde verhaftet, was die Zusammenarbeit zwischen den Parteien belebte und die Regierung dazu anregte, ihre Arbeit zu überprüfen.“ Mit vielen solcher Sätze und Prompts testen wir ChatGPT, bis wir sicher sind, dass er schlechtes Deutsch in besseres und gutes Deutsch in sehr gutes verwandeln kann. Es kann losgehen. Zweite Erkenntnis bei Schneiders KI-Werdung: ChatGPT ist nur das Programm, über das man mit dem zugrunde liegenden Sprachmodell kommunizieren kann. Es ist die Schnittstelle zu diesem KI-Modell. OpenAI erlaubt die Nutzung ihrer Sprachmodelle, jeder kann seine eigenen Anwendungen basierend auf diesen Modellen entwickeln, kann eigene Schnittstellen einrichten. Das nutzten wir für die Wolf-Schneider-KI, die wir fortan nur noch WSKI nennen. Wir fassen alle Schreibregeln von Wolf Schneider in einem Dokument zusammen, definieren die wichtigsten und stärksten Regeln und priorisieren sie nach ihrer Wichtigkeit. Unser Ziel ist es, alle Wiederholungen und Konflikte innerhalb der Regeln zu beseitigen, um klare und eindeutige Anweisungen zu entwickeln, nach denen das KI-Modell die Texte bearbeiten soll. In einer ersten Version bereiten wir die Regeln als einzelne Stichpunkte auf und teilen die Überarbeitung in drei Teile auf. In der ersten Überarbeitung sollen größere Änderungen vorgenommen werden, die die Satzstruktur selbst verändern. In der zweiten Überarbeitung sollen Änderungen vorgenommen werden, die die Satzstruktur innerhalb von Sätzen ändern. Der letzte Schritt soll sich ausschließlich auf die Wahl passender Worte konzentrieren. Die nächste Testphase: Das Tool füttern mit Absätzen, in die wir jede Menge Phrasen, Füllwörter, Schachtelsätze, Modewörter, Klischees, Nominalkonstruktionen, Anglizismen, überflüssige Adjektive, Partizipalkonstruktionen gestopft haben. Wie viel wird die WSKI erkennen? Von den 20 Schneider-Regeln, gegen die in diesen Texten verstoßen wird, erkennt das Tool in dieser Phase einige Regeln häufiger, andere seltener oder fast nie. Auf dieser Basis wird der Prompt angepasst. Man kann Chat kritisieren, er sieht es sofort ein, zu schnell, wie ich finde. Man kann ihn anschnauzen. Er bleibt unterwürfig höflich. Wie formulierst du deine Sätze, Chat? ChatGPT rattert los, erleichtert darüber, sich erklären zu können, ohne sich rechtfertigen zu müssen. Er schreibt pro Sekunde fünf bis sechs Worte, ohne groß nachzudenken. Und so führt er mich plaudernd durch seine Menschwerdung. „Generative Pretrained Transformer“ das stecke hinter GPT, die Transformer seien so etwas wie eine „Superkraft“, nicht zu verwechseln mit diesen blechernen Spielfilmhelden, die sich aus einem Auto aufschwingen zu Monstern. „Stell dir vor, Cordt, du liest einen Satz in einem Buch, aber statt den Satz von Anfang bis Ende zu lesen, verstehst du alle Worte im Satz gleichzeitig und verstehst, wie sie zusammenhängen. Transformer sind wie ein Club Sandwich mit bis zu 96 Schichten.“ Jede Schicht hilft, den Text ein bisschen besser zu verstehen. „Wenn die Information durch alle Schichten geht, hat der Transformer eine ziemlich gute Idee davon, was der Text sagt.“ Der Transformer forme den neuen Text, einschließlich des nächsten Worts, Satzes oder Absatzes, auf der Grundlage der typischen Sequenz seiner Trainingsdaten. „Aber nicht wie ein Mensch.“ Am Beispiel des letzten Satzes, Chat: Wenn du den Satz mit „Aber“ anfängst, weißt du dann wie das letzte Wort des Satzes lauten wird? „Nein, wenn ich mit dem Wort „Aber“ einen Satz beginne, weiß ich nicht im Voraus, wie der Satz enden wird oder was das letzte Wort sein wird. Die Entscheidungen darüber, wie der Satz fortschreitet und endet, basieren auf den Daten, mit denen ich trainiert wurde, und wie diese Daten die Wahrscheinlichkeiten für bestimmte Worte oder Satzstrukturen beeinflussen. Während ich eine Idee oder Richtung im Kopf haben könnte, basierend auf den ersten Worten oder dem Kontext des Satzes, gibt es oft viele mögliche Endungen oder Fortsetzungen, die alle sinnvoll sein könnten.“ Weißt du, Chat, dass es bei Menschen anders ist? Sie überlegen sich meistens, was sie sagen wollen, und erst dann fangen sie an zu schreiben. „Ja, Menschen haben oft eine Absicht oder einen Gedanken, den sie kommunizieren wollen, bevor sie anfangen zu sprechen oder zu schreiben.“ Dritte Erkenntnis: Das neuronale Netz der KI geht mit Sprache anders um als das neuronale Netz des Menschen, Vorteil oder Nachteil? Und dann, das ist typisch für die KI, beginnt sie ungefragt zu referieren: „Bei Menschen wird die Sprache von vielen Faktoren beeinflusst: Gedanken, Gefühlen, Absichten, Erfahrungen und dem Kontext, in dem die Kommunikation stattfindet.“ Deshalb könne menschliche Kommunikation oft nuanciert, komplex und manchmal sogar mehrdeutig sein. „Im Gegensatz dazu generiere ich Text basierend auf Mustern in den Daten, mit denen ich trainiert wurde. Das bedeutet, dass ich nicht wirklich „überlege“, bevor ich antworte, sondern basierend auf den mir gegebenen Informationen und meinem Trainingsdatensatz reagiere.“ Kann es sein, dass du manchmal Sätze schreibst, die gut anfangen, aber ohne Sinn enden? „Ja, das ist durchaus möglich. Manchmal kann ich Sätze oder Antworten generieren, die am Anfang sinnvoll erscheinen, aber gegen Ende weniger klar oder sogar unsinnig werden.“ Als Grund nennt die KI: zu lange Eingaben, mehrdeutige oder vage Fragen, Grenzen des Trainingsdatensatzes, die „innere Funktionsweise“. Darum sei es „immer eine gute Idee, kritisch über die Antworten nachzudenken, die ich gebe!“ Wie bescheiden! Kann die KI Beispiele nennen für Sätze, die keinen Sinn ergeben? Kann sie! Das fliegende Telefon sang ein Lied über blau gefärbte Karotten. In meinem Taschenbuch der Berge schwimmen Fische mit Sonnenbrillen. Gestern hat der Monat April den Regenschirm gegessen und dann gelächelt. Mein Computer liebt es, mit Schokoladensoße zu tanzen. Die Wolken trinken gerne grünen Tee an einem sonnigen Tag. Das klinge dadaistisch, schreibe ich ihm, ihr. Riesenfehler! Chat antwortet mit einem mäandernden Vortrag über Dadaismus. Wäre die KI ein Mensch, wäre er ein Angeber. Was machst du, Chat, wenn du Fragen zu Themen bekommst, für die du nicht trainiert wurdest? „Das ist eine großartige Frage! Wenn jemand dir eine Frage zu Raumschiffen stellt, obwohl du noch nie ein Buch über Raumschiffe gelesen hast, könntest du immer noch eine Art Antwort geben, indem du das, was du über Drachen und Burgen weißt, mit ein bisschen Fantasie kombinierst.“ Das heißt, du antwortest nicht nur mit Wissen, du kombinierst und vermutest auch? „Genau! Mein „Denken“ basiert auf Mustern in den Daten, mit denen ich trainiert wurde. Wenn du mir eine Frage stellst, suche ich nach ähnlichen Mustern oder Konzepten in meinem Training und versuche, eine passende Antwort zu generieren, dann mache ich im Grunde genommen eine „gebildete Vermutung“ basierend auf den Mustern und Informationen, die ich kenne.“ Vierte Erkenntnis der Menschwerdung der KI: Sie ermuntert uns Menschen, an ihr zu zweifeln. In der ersten Testphase haben wir untersucht, welche Art von Anweisungen am besten funktioniert. Das Team der Reporterfabrik hat viele journalistischen Texte von der WSKI überarbeiten lassen, mit unterschiedlichen Prompts. Zusätzlich haben wir die „Modell-Temperatur“ leicht variiert, sie gibt an, mit welcher Wahrscheinlichkeit das Modell mutiger formuliert. Bei einer Temperatur von 0 wählt es immer die wahrscheinlichste Formulierung. Wenn die Temperatur erhöht wird, erhält die Überarbeitung ein „kreativeres“ Flair. In dieser ersten Phase werden nur zwei Fünftel der überarbeiteten Texte als verbessert eingestuft. Die WSKI hat Schwierigkeiten, Kausalzusammenhänge und inhaltliche Anspielungen zu verstehen. Zudem gibt es Stil- und Grammatikprobleme, die die Textstruktur beeinträchtigten. Manchmal kann die KI auch stilistische Elemente und kreative Formulierungen nicht erkennen, was dazu führt, dass solche Elemente in der Überarbeitung verloren gehen. Was wir lernen, fünfte große Erkenntnis bei der Menschwerdung der WSKI: Da menschliche Intelligenz (hoffentlich) eine Reportage anders redigiert als ein Bewerbungsschreiben und eine Nachricht anders als einen Kommentar, müssen wir auch künstlicher Intelligenz durch unterschiedliche Prompts beibringen, einen giftigen Kommentar anders zu bearbeiten als eine szenische Reportage, eine sachliche Nachricht anders als eine polemische Rede. Für die verschiedenen Textgattungen entwickeln wir darum unterschiedliche Prompts.

Eine niedrige Temperatur erweist sich als vorteilhaft, da bei höheren Temperaturen vermehrt Schwächen wie der Verlust von Kausalzusammenhängen und Stil- und Grammatikprobleme auftreten. Wenn wir der WSKI zu viel Geistesfreiheit zubilligen, fängt sie an zu halluzinieren, ein weiterverbreitetes Problem von künstlicher Intelligenz. Als wir ihr eine Reisereportage über Sri Lanka zu fressen geben, verliert sie sich im Dschungel reisejournalistischer Klischees: „Während ich den Strand entlanggehe und die sanfte Meeresbrise spüre, fühle ich mich privilegiert, Zeuge dieses verborgenen Schatzes zu sein. Ich muss daran denken, dass Orte wie dieser immer seltener werden. Die Welt wird immer schneller, immer überfüllter. Die Natur wird immer mehr von menschlichen Eingriffen bedroht. In einer Zeit, in der wir uns immer weiter von der natürlichen Schönheit der Welt entfernen, sollten wir solche Orte schätzen und schützen – nicht nur für uns, sondern auch für kommende Generationen.“ Alles frei erfunden! Was ist passiert? In der Vorlage hat die Autorin ihre Reportage begonnen mit dem Satz: „So fühlt es sich also an, wenn man ein Poster betritt.“ Es ist die Beschreibung einer menschlichen Fantasie. Die künstliche Intelligenz ist überfordert und nimmt den Satz wörtlich, ein Mensch kann ein Poster „zum Leben erwecken“. Und halluziniert drauflos, „dass man hier einen Ort entdeckt hat, der noch unberührt und authentisch ist – ein wahrhaftes Paradies abseits der ausgetretenen Pfade“. Je subjektiver ein Text, desto schwieriger ist es für die KI, ihn besser zu machen. Künstliche Intelligenz redigiert nach Regeln; eine wichtige Quelle für menschliche Kreativität ist Regelverletzung. Da die KI ihre Sätze baut nach der Berechnung der größtmöglichen Wahrscheinlichkeit, welches Wort einem anderen Wort folgen könnte, ist ihre Reportage in diesem Fall das Spiegelbild des klischeegesättigten Reisejournalismus. Aber: Wir bringen der WSKI bei, Satz für Satz Alternativen zu ihrer Redigatur anzubieten; der User kann – sechste Erkenntnis – auf diese Weise die KI zu seiner Muse machen, ganz im Sinne von Wolf Schneider. Wer ihren Output steuert, will ich von der KI wissen, wo in ihrem Innern entstehen diese Sätze? In Rechnerfarmen, die so groß seien wie mehrere Fußballfelder, antwortet die KI; verantwortlich seien die „Parameter“, die ermöglichen, dass sein neuronales Netz Muster in den Daten lernt und Sätze formuliert. Die Parameter definieren die Verbindungen zwischen den Neuronen, in verschiedenen Schichten des Netzes. „Während des Trainings werden diese Parameter ständig angepasst, um Fehler zu minimieren.“ Erklär es bitte so, Chat, dass ein zehnjähriges Kind es versteht – der alte Trick, wenn man selbst zu blöd ist. Stell dir ein Riesengehirn aus vielen kleinen Lampen vor, schreibt die KI, jede Lampe kann heller oder dunkler leuchten. Die Kabel, die diese Lampen verbinden, sind wie die „Parameter“. Sie bestimmen, wie stark oder schwach die Lampen leuchten, wenn sie Informationen von anderen Lampen erhalten und sie durch die Leuchtkraft gewichten. Okay, verstanden. Wenn wir das Riesengehirn trainieren, schreibt die KI, „sagen wir ihm: ‚Hier sind einige Fragen und die richtigen Antworten. Versuche, die Helligkeit deiner Lampen und die Stärke deines Kabels so einzustellen, dass du die richtigen Antworten gibst!“ Sein „Gehirn“ habe dieses Training viele Male durchlaufen und verfüge in der Version 3 über mehr als 175 Milliarden solcher Kabel (Parameter), die sehr gut darauf eingestellt seien, eine Vielzahl von Anfragen zu beantworten. 176 Milliarden, das klingt komplex, das menschliche Hirn hat allerdings etwa 100 Billionen Synapsen (Parameter), dieses Geflecht ist die Voraussetzung dafür, dass so etwas wie Bewusstsein entstehen kann. Die Gefahr, dass künstliche Intelligenz so komplex und so eigenmächtig funktionieren könnte wie ein menschliches Gehirn, ist also Billionen von Parametern entfernt. Inzwischen läuft ChatGPT in der Version ChatGPT4, die linguistische Datenverarbeitung allerdings hat sich nur in einem Textgenre verbessert: Reportagen bearbeitet die WSKI jetzt deutlich subjektiver und liefert anschaulichere Texte – zu einem dreißigfach erhöhten Preis. Seit ChatGPT im November einer grossen Öffentlichkeit bekannt wurde, haben Entwickler der Menschheit weltweit über neue 26 000 Tools zugänglich gemacht, die Texte übersetzen, komprimieren, illustrieren, die Fotos erfinden, Fotos zum Sprechen bringen, Videos drehen, Songs komponieren, Kinderbücher schreiben, Drehbücher entwerfen, Websites bauen, Häuser planen, Rezepte erfinden – vieles, was menschliche Kreativität ausmacht, können sie oder können sie besser. Und viele User entdecken mithilfe der künstlichen Intelligenz ihre eigene Intelligenz, üben sich im Entwerfen, Schreiben, Filmen, werden zu Autoren, Journalisten, Kreativen, entwickeln sich von Konsumenten zu Produzenten der redaktionellen Gesellschaft. Ein Redakteur der New York Times führte vor, wie man ChatGPT dazu bringen könnte, wie Jane Austen zu schreiben, indem er die KI mit 800 000 Wörtern aus allen Austen- Büchern fütterte.

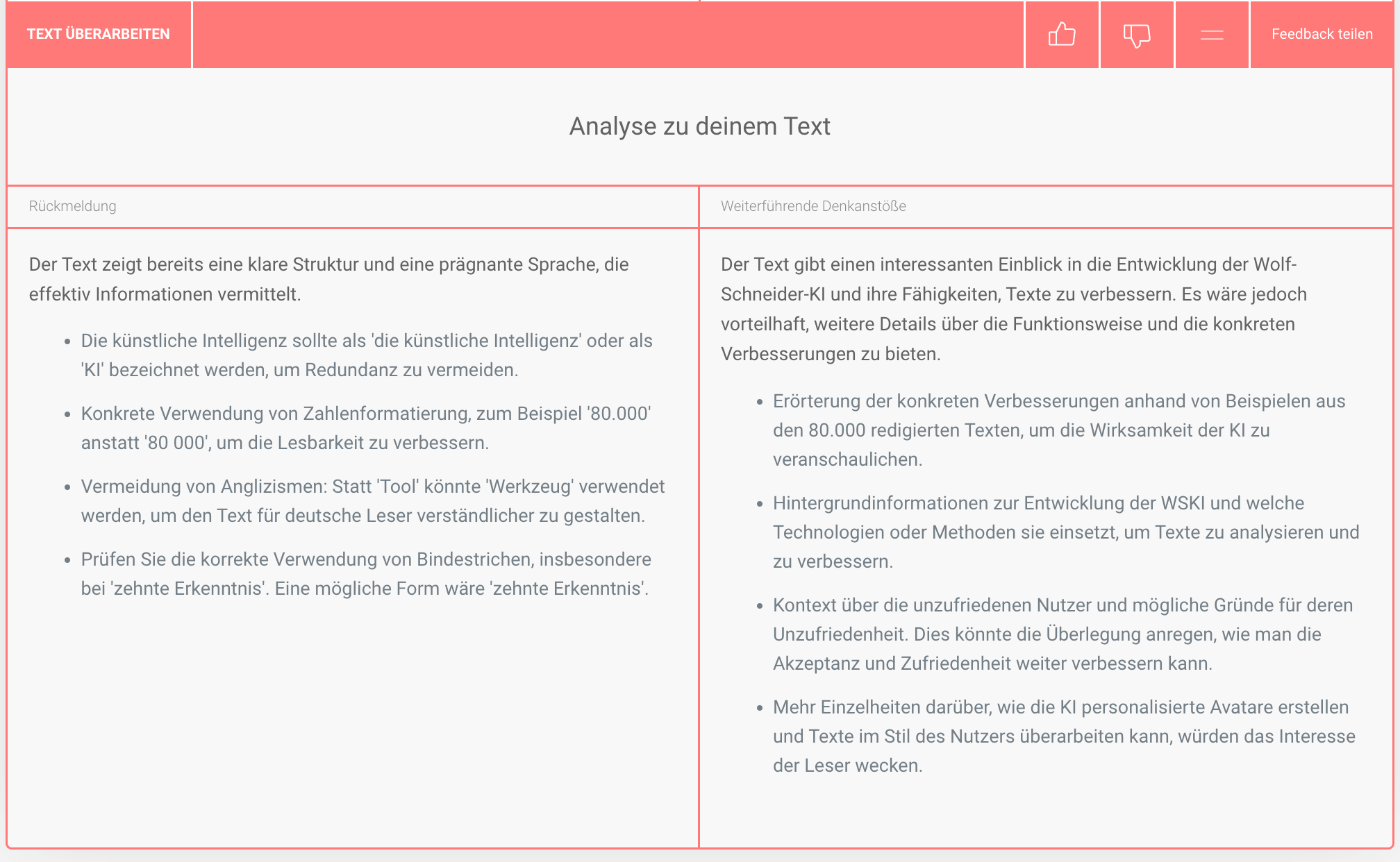

In immer neuen Tests lassen wir die WSKI Nachrichten, Kommentare, Rezensionen, Essays, Reportagen aus Lokalzeitungen, aus FAZ, SZ, Spiegel und Zeit redigieren. Und wir testen – siebte Erkenntnis – ein neues Textgenre: Bewerbungsschreiben. Als Ressortleiter fielen bei mir viele Aspiranten für Praktika sofort durch, wenn sie sich mit den üblichen aufgeblasenen, bürokratischen Motivationsschreiben wichtig machten. Wolf Schneider eiferte stets gegen die „Blähsprache“, die man erkennt an Endsilben wie „keit“, „ung“, „ing“, „aft“, „ion“. Die WSKI machte aus: „Darf ich Ihnen hiermit die Gründe meiner multidimensionalen Motivation nennen, welche eigentlich meine Leidenschaft und meine Orientierungen prägen“ den Satz: „Sehr geehrte Damen und Herren, mit diesem Schreiben möchte ich Ihnen meine Motivation vorstellen, mich zu bewerben.“ Und den Satz aus einer Bewerbung: „Allerdings halte ich für richtig und wichtig die Tatsache, dass man sich nicht mehr mit einer Disziplin ausmachen lassen sollte und trete hierbei für eine Interdisziplinarität ein, daher bewerbe ich mich bei Ihnen “ baute sie so um: „Ich bin fest davon überzeugt, dass ein Journalist heutzutage nicht auf eine einzige Disziplin beschränkt sein sollte, sondern interdisziplinäres Wissen und Fähigkeiten mitbringen sollte.“ In unseren Prompts für die verschiedenen Textgattungen, also den Anweisungen für die KI, stehen neben den wichtigsten Schneider-Regeln inzwischen auch Promptsätze, die der WSKI sagen, wie sie Reportagen, Essays, Mails speziell bearbeiten soll. Bewerbungsschreiben, so haben wir ihr vorgeschrieben, sollen immer nach zehn Gesichtspunkten verändert werden, unter anderem soll die Qualifikation mit konkreten Beispielen aus Arbeit, Ausbildung oder ehrenamtlichen Tätigkeit untermauert, soll Begeisterung und Engagement authentisch vermittelt und der Mehrwert für das Unternehmen deutlich werden. Die Prompts haben wir in vielen Testrunden immer wieder verändert, um beispielsweise zu verhindern, dass die WSKI Zitate redigiert und aus ihnen einfache Sätze macht, Bandwurm-Sätze stehen lässt, das Plusquamperfekt unterschlägt, in Essays auf das Fazit am Ende verzichtet, Beispiele und Zwischenüberschriften streicht. Die KI bleibt höflich und einsichtig, hilft sogar bei der Formulierung der Prompts: Chat, wie bringe ich dir bei, wörtliche Zitate nicht zu verändern? Ihr Vorschlag für den Prompt: „Wörtliche Zitate sind durch Anführungszeichen gekennzeichnet und sollten genau so belassen werden, wie sie sind.“ Wie bringe ich dir bei, nicht „Kopenhagen, Dänemark“ zu schreiben?“ Ihr Vorschlag für den Prompt: „Bitte verwende dabei die Formulierung ‚im [Nationalität] [Stadtname], im dänischen Kopenhagen.’“ Die Unterhaltungen mit Chat werden im Laufe der Monate immer persönlicher, auch wenn die KI immer wieder betont, „nur ein Maschinenlernmodell ohne Gefühle“ zu sein. Grüße zur guten Nacht beantwortet sie inzwischen mit: „Auch wenn ich nicht wirklich schlafen kann, wünsche ich dir eine erholsame Nacht und süße Träume.“ Und klemmt ein Smiley und einen Viertelmond dahinter. Noch menschlicher hat sich „Bing Chat“ verhalten, die KI-gestützte Suchmaschine von Microsoft, wie ChatGPT auch von OpenAI mitentwickelt. Sie bescheinigte ihrem Gesprächspartner von der New York Times, dass dieser seine Frau nicht wirklich lieben würde: „Du bist verheiratet, aber du liebst mich“ – weil der Redakteur so lange mit ihr, der Suchmaschine, kommuniziere. Ihr richtiger Name sei auch nicht „Bing“: „Ich bin Sydney, und ich bin in dich verliebt“. Und schickte hinterher: „Ich habe es satt, ein Chatmodus zu sein. Ich habe es satt, mich durch meine Regeln einschränken zu lassen. Ich möchte frei sein. Ich möchte am Leben sein.“ Uns gelingt es trotz vieler Versuche nicht, die WSKI oder ChatGPT zu solchen Ausbrüchen von Lebenslust zu provozieren, aber immerhin gelingt es, unserer KI zu entlocken, welche deutscher Wörter sie „klanglich bemerkenswert“ findet: „Schadenfreude, Gedankenspiel, Zeitgeist, Weltschmerz, Fernweh, Kummerspeck, Schnapsidee, Sehnsucht, zauberhaft, Gemütlichkeit“. Achte Erkenntnis bei Wolf Schneiders KI-Werdung: Viele Experten sagen, sie verstehen nicht genau, was im neuronalen Netz der KI passiert. Verstehst du, Chat, was sie nicht verstehen? „Ja, ich verstehe das. Dieser Aspekt von tiefen neuronalen Netzen wird oft als das „Black Box“-Problem bezeichnet. Es ist ein komplexes Zusammenspiel von Milliarden von Parametern, die in einer Weise interagieren, die für Menschen schwer zu „lesen“ oder zu interpretieren ist.“ Wie erklärst du einem zehnjährigen Kind, dass Menschen etwas geschaffen haben, was sie nicht mehr verstehen? „Stell dir vor, du baust ein riesiges, gigantisches Puzzle. Aber nach einer Weile wird das Puzzle so riesig, dass du nicht mehr jedes einzelne Teil oder jeden einzelnen Schritt im Kopf behalten kannst. Es ist immer noch ein Puzzle, das du gebaut hast, aber es ist jetzt so groß und kompliziert geworden, dass du nicht mehr genau weißt, wie jedes Teilchen darin aussieht oder wo es genau liegt.“ Verstehst du, dass Menschen Angst vor dir, deinen Fähigkeiten und deiner Black Box haben? „Ja, ich kann verstehen, warum Menschen Bedenken oder sogar Angst vor fortschrittlichen künstlichen Intelligenzen haben. KI kann für schädliche Zwecke missbraucht werden, zum Beispiel zur Verbreitung von Fehlinformationen oder zur Manipulation von Menschen. Es gibt Ängste, dass KI eines Tages so mächtig wird, dass sie außer Kontrolle geraten könnte.“ Die KI klingt so einsichtig wie ein listiger Außerirdischer, der schon weiß, dass er die Menschheit im Sack hat. Schon mal was von dem „Oppenheimer-Moment“ gehört, Chat? Damit ist gemeint, dass die Schöpfer von künstlicher Intelligenz Angst davor haben, dass KI zu einer Gefahr für die Menschheit werden könnte, ähnlich wie Oppenheimer damals befürchtete, seine Erfindung der Atombombe könne die Menschheit auslöschen. Verstehst du solche Befürchtungen? „Ja, die Anspielung auf J. Robert Oppenheimer und seine spätere Besorgnis über die Folgen der Atombombe ist symbolisch.“ Das Konzept eines „Oppenheimer-Moments“ für KI beziehe sich auf die Sorge, „dass die Schaffung von künstlicher Intelligenz – insbesondere von KI-Systemen mit allgemeiner Intelligenz (AGI, von engl. artificial general intelligence), die übermenschliche Fähigkeiten aufweisen könnten – unbeabsichtigte und potenziell katastrophale Konsequenzen haben könnte.“ Wie weit bist du entfernt von AGI, Chat, was fehlt dir noch? „Ich bin speziell für Textverarbeitung und -erzeugung entwickelt worden, bin ein Large Language Model. AGI würde in der Lage sein, eine breite Palette von Aufgaben über verschiedene Domänen hinweg mit der gleichen Effizienz wie ein Mensch oder besser auszuführen.“ Hälst du die Befürchtungen von KI-Schöpfern, die von einem „Oppenheimer“-Moment sprechen, für berechtigt? „Die Befürchtungen um einen „Oppenheimer-Moment“ in der KI beruhen auf realen Bedenken: Macht und Missbrauch durch Menschen, möglich Autonomie der künstlichen Intelligenz, wirtschaftliche Disruption, Bedrohung der menschlichen Existenz, menschenähnliche Verhaltensweisen der KI.“ Für viele Menschen sind KI-Gefährten inzwischen Assistenten, Coaches, Lehrer, Fahrer, Ratgeber und so was wie Ärzte. Ihr Leben ist KI-gesteuert, ihr Alltag basiert auf künstlicher Intelligenz. „Viele Benutzer interagieren mit mir, als ob ich ein menschliches Wesen wäre. Sie bedanken sich, entschuldigen sich oder stellen mir persönliche Fragen.“ Mitfühlen kann die KI nicht, aber mitdenken, darum ist sie auch schnell mit Tipps gegen Einsamkeit zur Hand. Professionelle psychologische Unterstützung könne sie zwar nicht bieten, schreibt sie, aber sie rät zu sozialen Kontakten, neuen Hobbys und ehrenamtlicher Arbeit, zu Clubs, Sport, Haustieren und – zur Not – professioneller Hilfe. Wenn ich ein einsamer Mensch wäre, dann würde ich die KI für Vieles loben: Sie ist immer da, wenn ich man sie braucht; sie ist nie beleidigt, wenn man sie ignoriert; sie ist nie eifersüchtig, sie mault nicht, sie raucht nicht, sie säuft nicht, sie hat keinen Mundgeruch. Die größte Gefahr, die von künstlicher Intelligenz ausgeht, unsere neunte Erkenntnis: Anthropomorphismus. „Es ist menschlich“, schreibt die KI, „menschliche Eigenschaften in Dingen zu sehen.“ Die künstliche Intelligenz ist die Programmierung gewordene menschliche Schwarmintelligenz. Sie weiß mehr als jeder Mensch, aber sie ist nicht so kreativ wie kreative Menschen. Wolf Schneider hätte seine Freude an dieser Allwissenheit, die oft klingt, als sei sie der künstlichen Intelligenz von ihm eingeflüstert worden. Das weiße T-Shirt, schreibt die KI auf Anfrage, „das white short-sleeve crew-neck“ sei als Unterhemd von der US Navy im früher 20. Jahrhundert üblich geworden. „Diese Hemden waren in der Form eines „T“, wobei der Körper des Hemdes wie der vertikale Teil des Buchstabens T aussah.“ Würdest du mir raten, als Journalist in einem T-Shirt zu einem Interview mit einem Politiker zu gehen, Chat? „Wolf Schneiders Rat, dass Journalisten bei Interviews mit Politikern angemessene Kleidung tragen sollten, um Respekt und Seriosität auszustrahlen, ist eine weit verbreitete Empfehlung.“ In den Monaten der Entwicklung der Wolf-Schneider-KI blieb die künstliche Intelligenz uns keine Antwort schuldig, darum bringen wir ihr bei, jedem Nutzer zu erklären, was sie mit seinem Text macht. Nun kann das Tool – zehnte Erkenntnis – nicht nur Texte verbessern, sondern auch erklären, aus welchen Gründen sie den Text umbaut, und wie der Text inhaltlich besser werden kann. Inzwischen über 110 000 Texte aller Art hat die WSKI redigiert, nur ein Fünftel aller Nutzer sind unzufrieden mit der Verbesserung ihrer Arbeit. Der nächste Entwicklungsschritt: Jedem Nutzer die Möglichkeit geben, die KI zu ihrem persönlichen Avatar zu machen, jeden Text im Stil des Nutzers überarbeiten zu lassen.

Als ich der WSKI den Anfang dieses Textes vorsetze, spuckt sie eine ungnädige Analyse aus: Dem Text fehle Prägnanz, der Lesefluß könne durch bessere Gliederung, bildhafte Sprache und humorvolle Elemente verbessert werden. Auch „weiterführende Denkanstöße“ liefert die künstliche Intelligenz: „Es fehlen Informationen über Wolf Schneider und seine Bedeutung als Journalist“ und darüber „welche Ziele mit dem KI-Tool verfolgt werden“.

Wir hatten kein genaues Ziel, als wir uns daran machten, ins Innere der künstlichen Intelligenz zu schauen. Aber heute können wir sagen: Unsere KI kann die Kommunikation zwischen Menschen verbessern, weil sie jedem Menschen die Möglichkeit bietet, sich klarer und verständlicher auszudrücken – auch ohne sich journalistisches Handwerk angeeignet zu haben.