Profil

E-Mail: author+251(at)correctiv.org

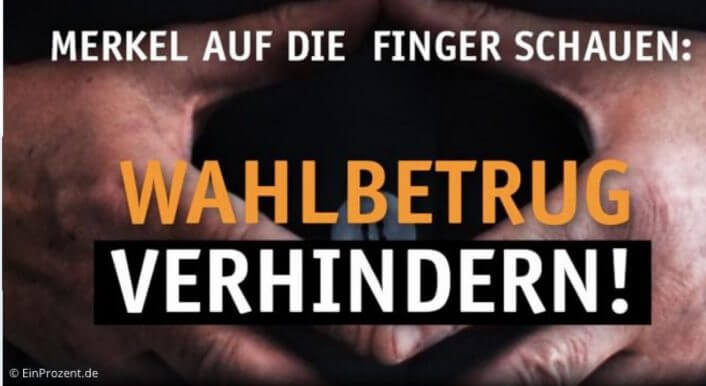

Aus Russland mit #Hass?

Wie funktioniert ein Bot-Angriff? Der Experte Ben Nimmo erklärt, wie die automatisierten Accounts arbeiten. Und vor allem fragt er: für wen?