KI-Video eines weinenden Lehrers in Frankreich schürt Rassismus

Personen fordern die Abschiebung von Schülerinnen und Schülern, weil sie angeblich ihren Lehrer in Frankreich zum Weinen gebracht hätten. Doch die Szene ist KI-generiert.

Die sofortige Abschiebung von Kindern fordert ein Nutzer in der Kommentarspalte unter einem Tiktok-Video, das über eine Million Aufrufe hat. Darin ist vermeintlich ein Lehrer namens „Monsieur Morel“ in Frankreich zu sehen, der von seinen Schülerinnen und Schülern ausgelacht wird und weint. Auf X behauptet jemand, die Schüler in dem Video seien „ausländische Kinder“. Diese Behauptung hat auch die ehemalige Tagesschau-Sprecherin Eva Herman, die seit Jahren Falschinformationen verbreitet, auf Telegram geteilt. Zehntausende sahen den Beitrag. Später löschte sie ihn.

Weitere Nutzer kommentieren zu dieser Szene Beleidigungen und Flugzeug-Emojis, die als rechte Chiffre genutzt werden, um sich für Abschiebungen auszusprechen. Doch den Vorfall gab es nicht, das Video ist KI-generiert.

Video mit Lehrer in Frankreich wurde mit Künstlicher Intelligenz erstellt

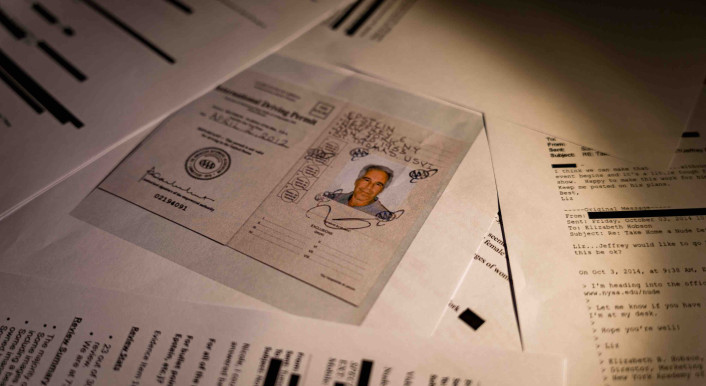

Das Video enthält mehrere logische Fehler. Die Hand des Lehrers greift durch den blauen Ordner hindurch. Die Anordnung der Tisch- und Stuhlbeine ergibt keinen Sinn und auf dem Handy des Jungen, der vermeintlich den Lehrer filmt, ist überwiegend eine weiße Wand zu sehen.

Mutmaßlicher Urheber des KI-Videos ist ein Tiktok-Profil namens „frenchi.a“, sein Wasserzeichen ist in den Videos zu sehen. Die beiden letzten Buchstaben des Namens „i.a“ können bereits als Hinweis auf Künstliche Intelligenz gedeutet werden, da dies der französischen Abkürzung für „intelligence artificielle“ entspricht. Zuvor berichtete die Nachrichtenagentur AFP.

Auf dem Tiktok-Profil sind zudem viele weitere solche KI-Videos sichtbar. Eine entsprechende Kennzeichnung, dass es sich um KI handelt fehlt, obwohl das laut Tiktoks Community-Richtlinien Pflicht ist. Auf eine Anfrage dazu reagierte die Person hinter dem Tiktok-Profil nicht. Eva Herman hat nach unserer Anfrage ihren Telegram-Beitrag gelöscht. An CORRECTIV.Faktencheck schreibt sie, sie bedauere den Fehler und bittet Leserinnen und Leser um Entschuldigung.

Immer wieder kommt es vor, dass Nutzerinnen und Nutzer KI-Videos in Sozialen Netzwerken für echt halten. So schürte beispielsweise auch ein KI-Video über Sozialhilfe Hass und Rassismus. Dieses Video war zwar als KI-generiert gekennzeichnet, doch der Hinweis ging bei der weiteren Verbreitung verloren.

Redigatur: Gabriele Scherndl, Max Bernhard

CORRECTIV im Postfach

Lesen Sie von Macht und Missbrauch. Aber auch von Menschen und Momenten, die zeigen, dass wir es als Gesellschaft besser können. Täglich im CORRECTIV Spotlight.