Einflussoperation enttarnt: Russland greift in deutschen Wahlkampf ein

Nach Recherchen von CORRECTIV hat eine russische Desinformationskampagne vor der Bundestagswahl rund 100 Fake-Nachrichtenseiten eingerichtet. Ihr Zweck: den Wahlkampf beeinflussen. In mehreren Fällen wurden sie bereits für Attacken auf Politiker genutzt.

Robert Habeck habe eine junge Frau vor Jahren missbraucht. Annalena Baerbock treffe sich auf ihren Afrika-Reisen mit einem Gigolo. Die Bundeswehr mobilisiere 500.000 Männer für einen Militäreinsatz in Osteuropa. Der Vorsitzende des Verteidigungsausschusses, Marcus Faber, sei ein russischer Agent. Und ein Migrationsabkommen mit Kenia bringe 1,9 Millionen Kenianer nach Deutschland.

Read the English version of this article here.

All diese Behauptungen haben etwas gemeinsam: Sie sind Desinformation, benutzten KI und Deepfakes und erschienen auf Fake-Nachrichtenseiten. Nach Recherchen von CORRECTIV sind sie Teil einer neuen russischen Einflussoperation mit dem Spitznamen „Storm-1516“, die seit drei Monaten in den Wahlkampf vor der Bundestagswahl eingreift.

Die Spuren führen zu einem Ex-Polizisten aus den USA, zur ehemaligen russischen Trollfabrik Internet Research Agency (IRA) und zum militärischen Geheimdienst GRU. Für die Einmischung in den US-Wahlkampf hat die Regierung die mutmaßlichen Verantwortlichen aus Russland auf ihre Sanktionsliste gesetzt.

Erst im November hatte das Bundesamt für Verfassungsschutz vor möglichen Versuchen der Einflussnahme durch fremde Staaten auf die Bundestagswahl 2025 gewarnt. Währenddessen liefen in Moskau die Vorbereitungen offenbar genau dafür. Unsere Recherchen zeigen: Nach dem Zerfall der Ampelkoalition und der Ankündigung der Neuwahl haben die Verantwortlichen für die Desinformationskampagne ihren Fokus schlagartig auf Deutschland verlegt.

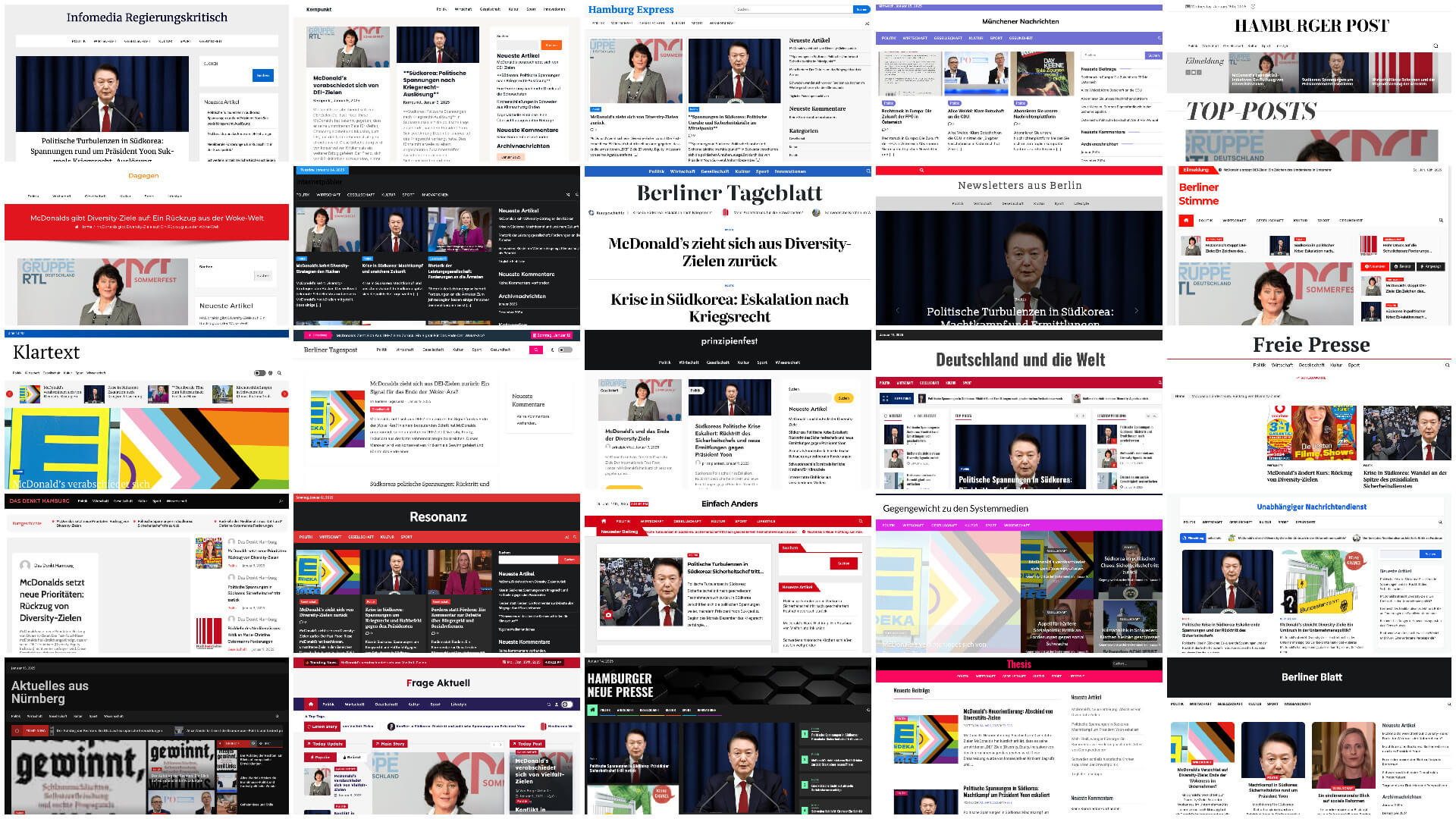

CORRECTIV hat in Kooperation mit Newsguard und mit Hilfe des Online-Rechercheprojekts Gnida ein Netzwerk von mehr als hundert deutschsprachigen Internetseiten aufgedeckt. Ein großer Teil davon wurde noch nicht für konkrete Falschmeldungen verwendet; sie wurden offenbar vorsorglich angelegt und warten wie Schläfer auf ihren Einsatz. Einmal aktiviert, werden die Fakes von pro-russischen Influencern in Deutschland verbreitet. Dadurch ist „Storm-1516“ nach Einschätzung von Experten effektiver darin, Reichweite zu erzielen. Potenziell ist sie damit gefährlicher als die parallel laufende sogenannte Doppelgänger-Kampagne.

Zuerst waren die USA dran: Ex-Polizist erstellte Fakes über Kamala Harris und Tim Walz

Um zu verstehen, was Russland in Deutschland vorhat, lohnt ein Blick zurück auf den US-Wahlkampf 2024.

Ab Sommer 2024 nimmt die Kampagne „Storm-1516“ in den USA die Präsidentschaftswahlen ins Visier – Ziel ist es offenbar, Donald Trump zum Sieg zu verhelfen. In den Monaten zuvor wurden bereits Falschbehauptungen zur Ukraine und den Olympischen Spielen verbreitet. Im September produziert die Kampagne ein Video über eine Frau, die angeblich 2011 als Mädchen von der demokratischen Kandidatin Kamala Harris bei einem Autounfall mit Fahrerflucht verletzt wurde und seitdem auf einen Rollstuhl angewiesen ist. Im Oktober folgen erfundene Missbrauchsvorwürfe gegen ihren Vizekandidaten Tim Walz.

Die Methode ist dieselbe, die „Storm-1516“ nun gegen Deutschland anwendet: Teils mit Schauspielerinnen und Schauspielern, teils auch mit Deepfake-Technologie werden Videos produziert, in denen vermeintliche Whistleblower oder Zeugen zu sehen sind. Basierend auf den Videos wird dann auf einer oder mehreren Webseiten der Kampagne eine Falschmeldung veröffentlicht. Bei dem Fake über Kamala Harris zum Beispiel von einem erfundenen Lokalmedium aus San Francisco. Ein Netzwerk von scheinbar unabhängigen Influencern verbreitet die Meldung dann weiter, zum Beispiel auf X oder Telegram.

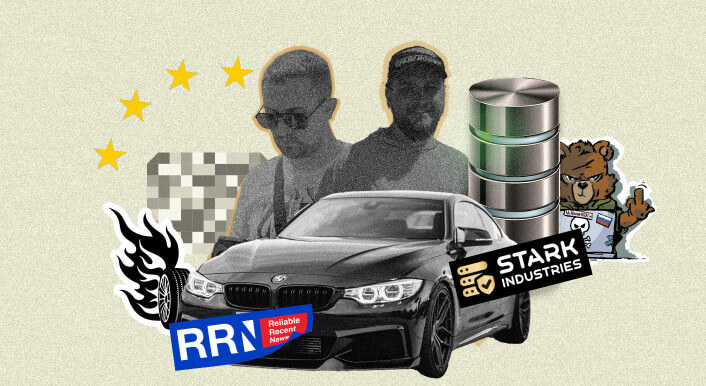

Es gibt Dutzende solcher gefälschter Nachrichtenseiten für die USA. Sie werden Recherchen zufolge von John Mark Dougan betrieben, einem ehemaligen Polizisten aus Florida, der jetzt in Moskau lebt. Ihm komme bei der Verbreitung der pro-russischen Propaganda eine zentrale Rolle zu. Dougan erstelle die Seiten und fülle sie mit Unterstützung von KI mit Artikeln. Unter dieses Füllmaterial mischen sich dann die handgemachten Fakes.

Mutmaßliche Verbindung zum russischen Geheimdienst GRU

Russische Dokumente, die von einem europäischen Geheimdienst beschafft wurden, zeigen laut einem Bericht der Washington Post, dass Dougan von einem Mitarbeiter des Geheimdienstes GRU finanziert werde. Auch laut US-Behörden wird diese Einflussnahme direkt vom russischen Geheimdienst GRU unterstützt. „Auf Anweisung des GRU und mit dessen finanzieller Unterstützung“ würden KI-Tools eingesetzt, „um in kürzester Zeit Falschbehauptungen zu erstellen, die über ein riesiges Netz von Webseiten verbreitet wurden, die legitime Nachrichtenmedien imitieren“, heißt in einer Mitteilung des US-Finanzministeriums von Dezember 2024.

Mit dieser Taktik hat die Kampagne Erfolg: Ihre Videos erzielen einer Analyse von NewsGuard zufolge Millionen Aufrufe, und auch prominente Politiker, wie der neue Vizepräsident J.D. Vance oder die Republikanerin Marjorie Taylor Greene, verbreiteten die Narrative von „Storm-1516“. Durch das Nutzen von Influencern sei die Kampagne deutlich effektiver als beispielsweise die parallel laufende Doppelgänger-Kampagne, sagt Darren Linvill von der Clemson University. „Das Engagement [Reichweite und Interaktionsrate, Anm. d. Red.] von Storm-1516 bei einigen dieser Stories ist einfach erstaunlich“, so der Forscher, der die Kampagne schon länger beobachtet.

Recherchen von CORRECTIV und Newsguard zur technischen Vorgehensweise legen nahe, dass dasselbe Netzwerk wie in den USA auch hinter den deutschsprachigen Webseiten stecken könnte. Dougan bestreitet auf Nachfrage jede Verbindung mit dem GRU oder einer anderen russischen Regierungsstelle. Die russische Regierung sei „ein Haufen idiotischer Bürokraten, die nie etwas zustande bringen“, dafür habe er keine Geduld. Detaillierte Fragen zu den Webseiten und seiner Beteiligung an der Kampagne beantwortete er nicht.

Von einer Wahl zur nächsten: Mehr als 90 Webseiten warten auf ihren Einsatz in Deutschland

Ab November, als die Neuwahlen in Deutschland verkündet wurden, sattelte die Desinformationskampagne um und fokussiert sich auf ihr neues Ziel.

Bereits ab Sommer 2024 hatte „Storm-1516“ einzelne Falschnachrichten produziert, die Deutschland ins Visier nahmen. So zum Beispiel im Juli 2024 die Behauptung, in einer Berliner Moschee sei ein Schweinekopf in einer Palästina-Flagge mit der Aufschrift „Ukraine steht für Israel“ geworfen worden. Diese erschien auf einem Portal namens „Berliner Wochenzeitung“; eine solche Zeitung gibt es nicht.

Der Fake, bei dem Baerbock eine Affäre mit einem Gigolo unterstellt wurde, erschien im August auf einer Seite namens „Zeitgeschenen“ (der Name enthält einen Tippfehler). Bisher noch nicht berichtet wurde über einen Deepfake, der den FDP-Verteidigungspolitiker Marcus Faber diskreditieren sollte. Er wurde von einem angeblichen Ex-Mitarbeiter in einem Video beschuldigt, ein russischer Agent zu sein. Ein Artikel, der auf das Video verwies, erschien auf einer Seite namens „Andere Meinung“. Womöglich, weil er einen Tag vor dem Zerfall der Ampelkoalition im November lanciert wurde, hat der Fall kaum Aufmerksamkeit erfahren.

Kurz darauf kommt so richtig Bewegung ins Netzwerk. Seit dem 19. November haben die Verantwortlichen in drei Wellen mindestens 99 weitere solcher Domains eingerichtet. CORRECTIV hat die Internetseiten zusammen mit dem Gnida Project anhand von technischen Merkmalen ausfindig gemacht. Sie tragen Titel wie „Scheinwerfer“, „Widerhall“, „Wochenüberblick aus Berlin“ oder „Unabhängiger Nachrichtendienst“.

Das Bundesamt für Verfassungsschutz will sich zu der Kampagne nicht äußern. Ein Sprecher teilt jedoch mit: „Die Registrierung themenbezogener Domains in Vorbereitung einzelner Desinformationskampagnen entspricht der bekannten Vorgehensweise russischer Einflussakteure.“

„Diese [Seiten] stimmen eindeutig mit den Storm-1516-Webseiten überein“, sagt Darren Linvill, der Professor von der Clemson University. CORRECTIV hat ihm einige der deutschen Seiten gezeigt. Dass die Seiten zu „Storm-1516“ gehören, lasse sich unter anderem an den Inhalten erkennen, die sehr einheitlich von anderen Medien geklaut würden. Auch beim Verbreitungsmechanismus gebe es Übereinstimmungen.

Ein Großteil wird schon automatisiert mit Inhalten bespielt, nur wenige sind noch ganz leer. Die anderen Inhalte enthalten zwar keine Fakes, sind aber alles andere als neutral. Laut den Analysen von Newsguard stammen die Inhalte beispielsweise von rechten Medien wie Compact und Philosophia-Perennis, oder pro-russischen Blogs wie Nachdenkseiten oder der russischen Seite RT DE. Die Texte wurden laut Newsguard mittels Sprachmodellen, also künstlicher Intelligenz abgeändert. Dieselbe Methode verwendete der Ex-Polizist Dougan in den USA.

Die vorbereiteten Webseiten zeigen: Die Kampagne steht vor der Bundestagswahl in den Startlöchern. Das jüngste Beispiel zeigt anschaulich, welche Desinformation uns möglicherweise in diesem Wahlkampf noch mehrfach droht.

Stimmungsmache mit einem Migrationsabkommen mit Kenia

Am 19. Dezember 2024 erscheint auf der Webseite „Presseneu“ neben all den automatisch generierten Inhalten eine Falschinformation. Sie thematisiert ein einige Monate zuvor abgeschlossenes Migrationsabkommen zwischen Deutschland und Kenia.

Dieser Artikel soll Emotionen erzeugen, er trägt die Überschrift „Deutschland plant den Import von 1,9 Millionen kenianischen Arbeitskräften: Eine neue Migrationskrise am Horizont?“ Die Zahlen sind absolut unrealistisch. Im Artikel wird als Quelle auf zwei Texte auf Webseiten etablierter Medien verwiesen: das kenianische Portal Tuko und das südafrikanische The South African.

Nur: Beide Texte sind keine redaktionellen Inhalte, sondern gesponsert – jemand hat für die Veröffentlichung bezahlt. Nur wer? Auf Anfrage reagierte Tuko nicht. Laut The South African erhielt die Seite 12.000 südafrikanische Rand für den Artikel, umgerechnet 620 Euro. Die Kontaktdaten des Kunden teilte das Portal nicht mit, aber nach einer Weile meldete sich ein angeblicher Mittelsmann bei CORRECTIV. Er habe den Artikel „im Zuge einer breiteren Bezahl-Kampagne“ bezahlt. Wer war sein Auftraggeber? Keine Antwort.

Die beiden seriös wirkenden Quellen sollen die Glaubwürdigkeit des deutschen Berichts von „Presseneu“ erhöhen – das nennt man „Informationswäsche“. Bei dem Baerbock-Gigolo-Thema wurde ein ganz ähnliches Prinzip genutzt, die Quelle war da eine Werbeanzeige bei der nigerianischen Daily Post.

Wenige Stunden nach Veröffentlichung wird der „Presseneu“-Artikel auf X und Telegram in Umlauf gebracht – teilweise von Influencern mit großer Reichweite. So zieht der Artikel Kreise in Sozialen Netzwerken und kann seine Wirkung entfalten.

Rechte, russlandnahe Influencer verbreiten die Fakes stets auffällig früh

Die Verbreitung der Inhalte durch reale Personen ist ein weiteres Merkmal der Kampagne „Storm-1516“. Das Einbeziehen von Influencern bewertet das Bundesamt für Verfassungsschutz als „erprobten Modus Operandi insbesondere russischer Einflussakteure“. Es sei daher möglich, dass diese „entsprechende Aktivitäten im Vorfeld der Bundestagswahl entfalten“, teilte das Amt auf Anfrage von CORRECTIV mit. Und tatsächlich: Mit der Fokussierung der Desinformationskampagne auf Deutschland kamen mehr und mehr deutschsprachige, pro-russische Influencer dazu.

Es fällt auf, dass es immer wieder dieselben Personen sind, die die Fakes mit als erste verbreiten. Darunter Michael Wittwer, früherer Kandidat für die rechtsextreme Partei Pro Chemnitz, Jovica Jović, ein pro-russischer Aktivist und Alina Lipp, eine pro-russische Influencerin, die einen reichweitenstarken Kanal auf Telegram betreibt. Geteilt werden ihre Beiträge sehr oft von Alena Dirksen, zuletzt Wirtin eines russischen Restaurants in Mittweida.

Eine offene Frage ist, ob Influencer in Deutschland dafür bezahlt werden, Desinformation zu verbreiten. Aus dem US-Wahlkampf ist ein Fall dokumentiert, in dem Geld floss: Gegenüber CNN gab der X-User @AlphaFox78, ein Trump-Anhänger mit hunderttausenden Followern, an, mehrmals je 100 US-Dollar für die Verbreitung von Videos und Memes erhalten zu haben. Die Summe habe er von Simeon Boikov erhalten, einem pro-russischen Propagandisten aus Australien, der im Internet als AussieCossack bekannt ist.

Boikov verbreitete auch selbst die Falschinformationen, mit denen Deutschland angegriffen wurde. Er war einer der ersten, der den Baerbock-Fake auf X postete. Beim Schweinekopf-Fake zog er nach ein paar Stunden nach.

Ein deutscher rechter Influencer, der auf X unter dem Pseudonym „Ganesha“ unterwegs ist, deutete Anfang Dezember ähnliches an: Er habe ein „Angebot eines patriotischen Shops“ abgelehnt, bezahlte Werbung zu machen, „und nun etwas nicht geteilt, was ziemlich sicher Fake News war“. Er meinte den Habeck-Fake. Einige Tage später verbreitete „Ganesha“ dann den Bericht von „Presseneu“ über das Einwanderungsabkommen mit Kenia und schrieb dazu: „P.S. Gesponserter Beitrag, weder Putin, Mossad oder Trump bezahlten mich.“ Auf Kontaktversuche reagierte er bisher nicht.

Gegenüber CORRECTIV verneinen sowohl Jović als auch Dirksen, dass sie für die Verbreitung der Inhalte Geld angeboten bekommen hätten. Dirksen sagt jedoch: „Es würde mich nicht wundern, wenn sowas existiert.“

Eine Stiftung als Sammelbecken für pro-russische Influencer

Es gibt noch ein weiteres verbindendes Element zwischen den Influencern. Sie alle haben mit der russischen „Stiftung zur Bekämpfung der Repression“ (FBI) zu tun. Dabei handelt es sich um ein Portal, das sich zur Aufgabe gemacht hat, auf vermeintliche Missstände in westlichen Staaten aufmerksam zu machen. Es gibt auch eine deutsche Sektion.

Jović und Lipp werden in Artikeln auf der Webseite der Stiftung zitiert. Laut Jović allerdings nicht freiwillig – ein Video, das dort in einen Artikel eingebettet worden ist, sei ursprünglich aus seiner eigenen Telegram-Gruppe und zusammengeschnitten. Er distanziere sich von dem Text der Stiftung, so Jović. Alina Lipp antwortete uns nicht. Dirksen und Wittwer teilten mehrfach deutschsprachige Artikel der FBI in ihren Netzwerken, antworteten auf unsere Fragen dazu jedoch nicht.

Warum ist diese Stiftung interessant? Sie wurde gegründet vom einstigen Leiter der berüchtigten Trollfabrik Internet Research Agency (IRA), Jewgenij Prigoschin. Nach dessen Tod im August 2023 ist mutmaßlich ein Teil dieses Apparats in die Kampagne „Storm-1516“ übergangen. Zu diesem Schluss kommt das Threat Analysis Center von Microsoft laut New York Times. Darren Linvill von der Clemson University sieht ebenfalls Parallelen. Die Aufgabe der „Stiftung zur Bekämpfung der Repression“ beschreibt er als „globale Rekrutierung von Influencern mit dem Zweck, Desinformation zu streuen“.

Hauptsache, es bleibt etwas hängen

Die von uns aufgedeckte Einflussoperation gegen Deutschland zeigt, dass die Gefahr durch russische Desinformation real ist: Mit der Diskreditierung einzelner Politiker soll der Wahlkampf zur Bundestagswahl beeinflusst werden. Mitunter erscheinen die Versuche plump. Tatsächlich ist es wenig glaubwürdig, dass der FDP-Politiker Marcus Faber, ein entschiedener Unterstützer der Ukraine, ein russischer Agent sei. „Ich hätte der russischen Propaganda mehr Raffinesse zugetraut“, kommentierte Faber den Fake gegenüber CORRECTIV.

Doch egal wie glaubwürdig sie sind: Die Erzählungen werden hartnäckig wiederholt und offenbar gibt es bisher kaum geeignete Gegenmaßnahmen. So finden sich auf X bis zuletzt Beiträge über den Baerbock-Fake. Dass dieser inzwischen enttarnt ist, ist wohl egal. Hauptsache, das Gerücht bleibt in der Welt.

Die Technik hinter der Recherche

Ausgangspunkt der Recherchen war die Falschinformation über das Migrationsabkommen in Kenia, die im Dezember verbreitet wurde. Da die Internetseite „presseneu.de“ noch online war, konnten wir sie auf technische Merkmale untersuchen. Dabei haben wir festgestellt, dass offenbar auf demselben Server zwei weitere Internetseiten liegen, die ganz ähnlich aufgebaut waren, jedoch bisher nirgends in Erscheinung getreten sind.

Gemeinsam mit dem anonymen Freiwilligen-Projekt Gnida konnten wir durch bestimmte Suchparameter Dutzende weitere Websites entdecken. Verbindende Elemente sind beispielsweise die Registrierungsdaten, die demselben Muster folgen. Dabei werden zufällige Adresse und Namen kombiniert. Eine stets gleich aufgebaute Email-Adresse beim Anbieter Gmail verbindet jeweils drei Internetseiten. Auch werden die Internetseiten häufig durch dieselben, jedoch mittels KI veränderten Inhalte bespielt.

CORRECTIV veröffentlicht die Liste jener 102 deutschsprachigen Domains, die wir der Kampagne „Storm-1516“ zurechnen (Tabelle zuletzt aktualisiert am 4. Februar 2025). Die wahre Zahl der Internetseiten könnte noch größer sein.

Auffällig ist, dass die technische Infrastruktur – anders als bei der Kampagne „Doppelgänger“ – gar nicht erst groß verschleiert wird. So ist offen einsehbar, dass sich die Internetseiten auf drei Hosting-Provider verteilen – darunter ist die deutsche Firma Sim Networks aus Karlsruhe. Konfrontiert mit den Propaganda-Seiten hieß es von dort lediglich, man könne „solche Anfragen ausschließlich aufgrund eines rechtskräftigen Gerichtsbeschlusses, oder auch auf Anordnung der Staatsanwaltschaft bearbeiten und beantworten“.” Der litauische Hosting-Riese Hostinger teilte mit, man untersuche die Informationen und unternehme, wenn nötig, entsprechende Schritte. Das US-amerikanische Unternehmen Namecheap reagierte nicht auf eine Anfrage.

Korrektur, 10. Februar 2025: Jewgenij Prigoschin starb laut Berichten nicht im Juni, sondern im August 2023. Wir haben diese Angabe im Text korrigiert.

Korrektur, 11. Februar 2025: Das Unternehmen Sim Networks wurde am Amtsgericht Mannheim registriert, stammt aber aus Karlsruhe. Ursprünglich hieß es im Text, das Unternehmen sei aus Mannheim.

Recherche: Alexej Hock, Max Bernhard, Sarah Thust, Till Eckert, Max Donheiser

Faktencheck: Alice Echtermann

Redigatur: Alice Echtermann

Grafiken: Laila Shahin

Titelgrafik: Ivo Mayr

Kommunikation und Social Media: Katharina Roche, Laura Seime, Esther Ecke, Anna-Maria Wagner