Irreführender Kettenbrief: Was die KI auf Whatsapp darf – und was nicht

Ein Kettenbrief warnt in Sozialen Netzwerken vor der Meta KI auf Whatsapp. Die habe angeblich Zugriff auf alle Chats, doch das stimmt nicht. Fachleute kritisieren die Meta-KI zwar für Datenschutzrisiken und die Speicherung vieler Daten, aber Nutzerinnen und Nutzer können sich davor schützen.

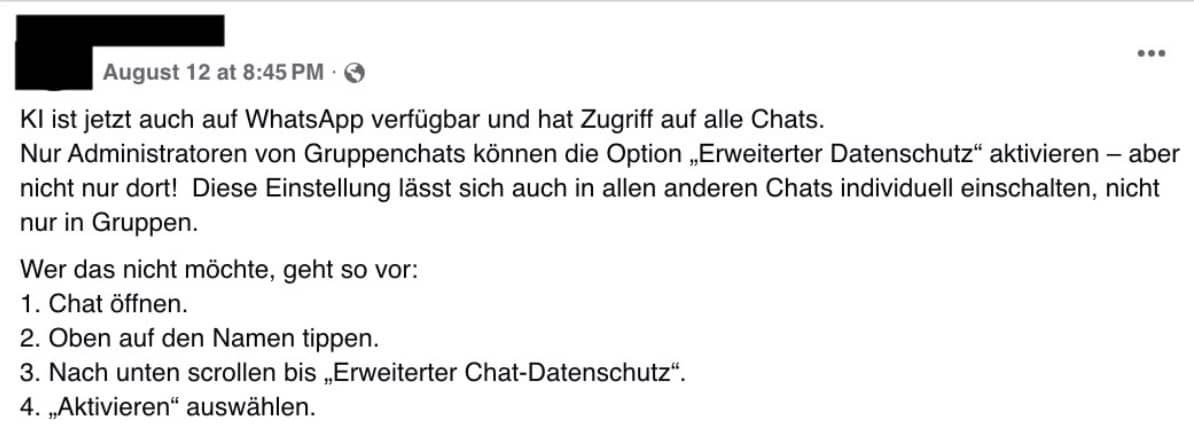

„KI ist jetzt auch auf Whatsapp verfügbar und hat Zugriff auf alle Chats“, heißt es in einem Kettenbrief, der im August 2025 in Sozialen Netzwerken kursierte. Nur Administratoren von Gruppenchats könnten das ausstellen, indem sie die Option „Erweiterter Chat-Datenschutz“ aktivieren. Ähnliche Behauptungen kursierten auch im englischsprachigen Raum. Einige Leser baten uns, der Sache nachzugehen.

Was an dem Kettenbrief dran ist, beantwortete uns die Verbraucherzentrale Nordrhein-Westfalen per E-Mail: „Der Kettenbrief kommt sehr dramatisch daher, aber er enthält falsche Informationen und ist daher geeignet, Nutzer:innen zu verunsichern.“ Die KI habe nicht automatisch Zugriff auf die Inhalte von Gruppen- oder Einzelchats. Nur wenn Personen Meta AI gezielt nutzen, würden die Anfragen an die KI-Systeme weitergeleitet. Es stimmt aber nicht, dass die Meta-KI automatisch auf alle Whatsapp-Chats Zugriff hat. Wer nicht will, dass sie Nachrichten mitliest, sollte sie nicht nutzen – um einen Chat zu schützen, gibt es eine zusätzliche Funktion.

Geht es um die Produkte von Meta, sind unabhängige Fachleute auf Angaben des Konzerns und von Verbrauchern angewiesen. Das gilt auch für die KI: Wie sie konkret funktioniert und welche Daten sie nutzt, legt der Social-Media-Konzern nicht detailliert offen.

Auf unsere Frage, was an dem Kettenbrief dran ist, antwortete die Pressestelle von Meta in Deutschland, die Meldung sei nicht korrekt. „Wenn Sie sich dafür entscheiden, Meta AI in Ihren Chats zu nutzen, kann sie nur das lesen, was Sie mit ihr teilen.“ Auf die Frage, wie das Unternehmen allgemein mit der Kritik an Meta AI umgeht, antwortete die Pressestelle nicht.

Meta hatte Ende März 2025 in der EU die KI-Option Meta AI in seinen Apps Whatsapp, Facebook und Instagram angekündigt. Solche Modelle lernen aus den Informationen, die man ihnen gibt, und sind anfällig für Fehlfunktionen. Die Verbraucherzentrale in Deutschland kritisierte die Umsetzung durch Meta, vor allem weil Meta Nutzerdaten zum Training heranzieht – nach dem Motto: Wer nicht aktiv widerspricht, stimmt dem automatisch zu.

Nein, die KI hat nicht automatisch auf „alle“ Whatsapp-Chats Zugriff

Im FAQ der Messaging-Plattform steht konkret: „Der wichtigste Punkt ist, dass deine persönlichen Chats mit Freund*innen und Familie für die KI tabu sind. Die KI kann nur das lesen, was du mit ihr teilst.“ Das heißt erstmal: Wer den Chat mit der KI nicht öffnet, teilt auch nichts – entfernen lässt sie sich aber nicht komplett. Und: Es ist in einem Chat möglich, dass einer der Beteiligten die KI bittet, Nachrichten zusammenzufassen. Das jedoch lässt sich seit April 2025 abstellen: über den erweiterten Chat-Datenschutz.

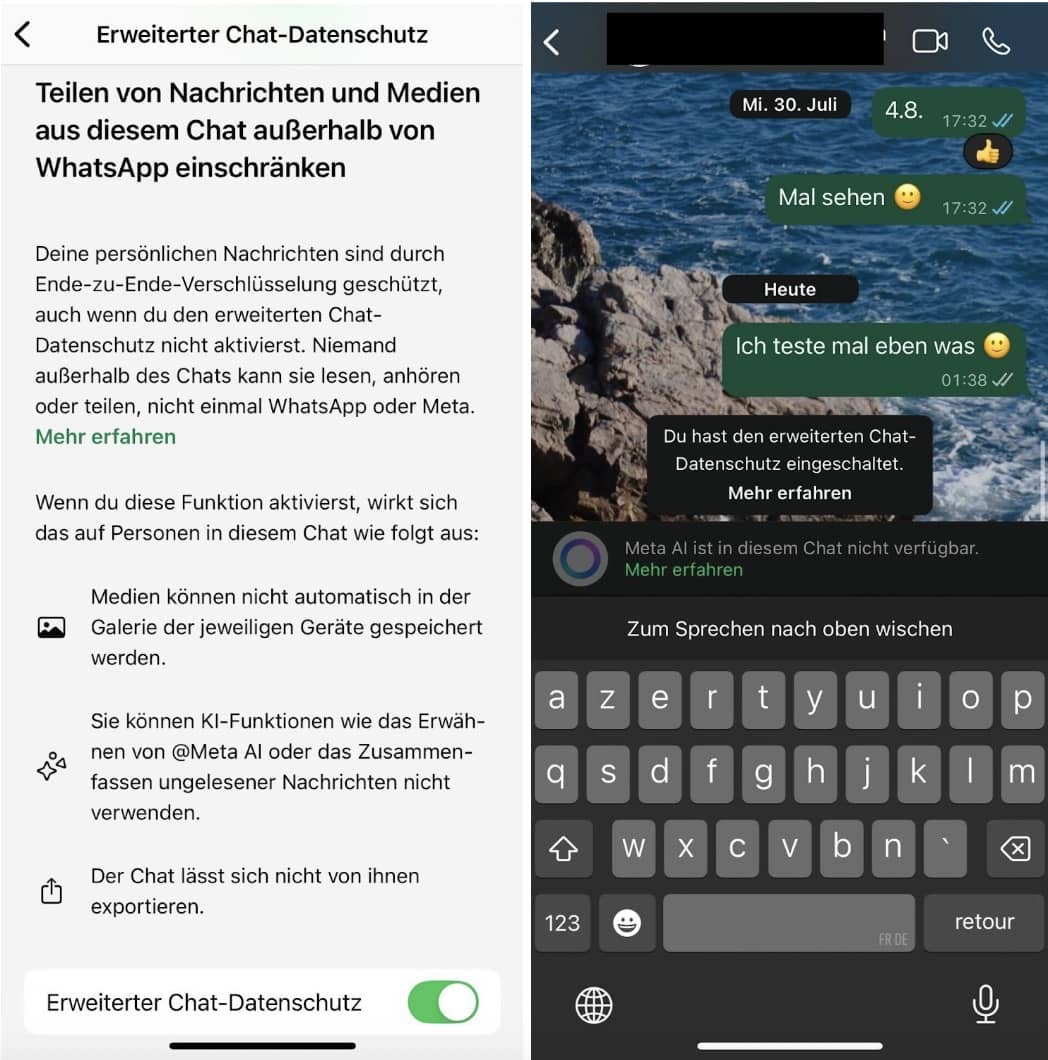

CORRECTIV.Faktencheck hat das am 28. August getestet: Egal ob in einem Privatchat oder in einer Gruppe – jedes Mitglied kann den erweiterten Chat-Datenschutz aktivieren. Die KI-Funktion kann dann in dem Chat nicht mehr verwendet werden (siehe Foto rechts). Darüber hinaus lassen sich Nachrichten nicht mehr gesammelt herunterladen und Fotos werden nicht mehr automatisch auf den Handys aller Chat-Mitglieder gespeichert.

Die Meta-KI scheint also nur Zugriff auf die Nachrichten zu haben, auf die sie direkt angesprochen wird – zum Beispiel, wenn jemand sie auffordert, ungelesene Nachrichten in einem Chat zusammenzufassen. Allgemein bleiben persönliche Nachrichten aber weiterhin Ende-zu-Ende-verschlüsselt, Whatsapp-Kontoinformationen werden laut Angaben des Konzerns nicht mit anderen Apps von Meta geteilt.

Vergangene Interaktionen mit der Meta KI können Nutzer zudem nachträglich hier löschen (Abschnitt: „Für KI bei Meta verwendete Informationen“). Allerdings ist das umständlich – und der Konzern schreibt selbst, dass die KI ein gelöschtes Detail unter Umständen weiterhin verwendet, zum Beispiel um ihre Antworten zu verbessern.

Fachleute kritisieren Metas Einführung der KI-Funktion

Wirtschaftsinformatiker Jonas Fegert am Karlsruher Institut für Technologie und am FZI Forschungszentrum Informatik schreibt: Problematischer sei, dass das dahinter liegende Modell „LLAMA“ auch auf Basis öffentlicher Facebook- und Instagram-Beiträge trainiert wurde. Diese Art von Datennutzung sei „nicht untypisch“ für das Training von generativer KI und werde so auch von Google und ChatGPT betrieben.

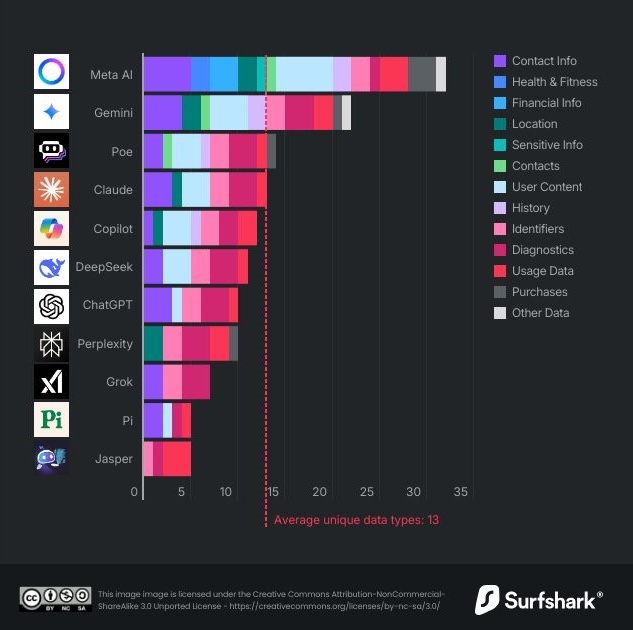

Das Unternehmen Surfshark, das als VPN-Anbieter Geld mit verschlüsselten Internetverbindungen verdient, wertete in einer Analyse aus, wie viele Datenpunkte unterschiedliche KIs von Nutzerinnen und Nutzern sammeln. Meta AI führte laut der Auswertung von Mai 2025, es sammelte demnach mehr persönliche Daten als zum Beispiel Google Gemini oder ChatGPT. Darunter sensible Informationen über sexuelle Orientierung, religiöse Überzeugungen und biometrische Daten.

Ende Mai begann Meta in Europa, öffentliche Nutzerdaten aus seinen Apps zum Trainieren der Künstlichen Intelligenz zu nutzen. Nutzerinnen und Nutzer von Facebook, Instagram oder Whatsapp mussten dem explizit widersprechen. Verbraucherschützer kritisieren so ein „Opt-Out“ und halten eine aktive Zustimmung für notwendig.

In einer Pressemitteilung schrieb die Verbraucherzentrale Nordrhein-Westfalen: „Aus unserer Sicht bleibt die Nutzung personenbezogener Daten für das Training der Meta eigenen KI hoch problematisch.“ Es bestünden „erhebliche Zweifel“ an der Rechtmäßigkeit dieses Vorgehens. Doch einen Eilantrag gegen die automatische Datennutzung für das KI-Training lehnte das Oberlandesgericht Köln ab (Aktenzeichen 15 UKl 2/25).

Auf Nachfrage von CORRECTIV.Faktencheck Anfang September erklärte die Verbraucherzentrale Nordrhein-Westfalen, dass sich Meta bei seinem Vorgehen auf ein „berechtigtes Interesse“ stützte, um die Daten ohne aktive Zustimmung seiner Kundinnen und Kunden verwenden zu können. Das bedeute aber nicht, dass die Verwendung personenbezogener Daten für KI-Training immer über ein berechtigtes Interesse legitimiert werden könne. „Wir gehen davon aus, dass das letzte Wort noch nicht gesprochen ist und eines Tages der Europäische Gerichtshof entscheiden wird.“

Aus Sicht der Verbraucherzentrale NRW besonders problematisch: Die Datenverarbeitung rückgängig zu machen, sei kaum noch möglich, wenn die Daten erst für die KI verwendet wurden. Es müsse zudem davon ausgegangen werden, dass auch besonders sensible Daten – etwa zur politischen Meinung, Gesundheit oder Sexualität – sowie Daten von Minderjährigen in das KI-Training einfließen würden. Außerdem hätten sich viele Personen gemeldet, bei denen der Widerspruch nicht funktioniert habe.

Künstliche Intelligenz kann ein nützliches Werkzeug sein, aber Nutzer sollten sich über Risiken informieren

Wie bei allen Technologien kann der Einsatz von Künstlicher Intelligenz hilfreich sein, birgt aber auch Risiken. Wer sicher gehen will, sollte sich daher über den Datenschutz auf der jeweiligen Plattform informieren. Wenn man auf Whatsapp die KI kontaktiert, kommt der Hinweis: „Teile keine Informationen, insbesondere nicht zu sensiblen Themen, über Dritte oder dich selbst, von denen du nicht möchtest, dass die KI sie speichert und verwendet.“

Darüber hinaus gibt es bei der Entwicklung künstlicher Intelligenz noch andere Schwachstellen. So sollte, wer KIs wie die von Meta befragt, deren Antwort nicht ungeprüft hinnehmen. „Einige der KI-generierten Nachrichten sind möglicherweise falsch oder unangemessen“, steht zum Beispiel im FAQ von Whatsapp.

So berichtete die Nachrichtenagentur Reuters im August über ein internes Dokument von Meta Platforms, in dem die Standards gesetzt werden, die dem generativen KI-Assistenten Meta AI und den Chatbots zugrunde liegen. Das habe den künstlichen Intelligenzen des Unternehmens ermöglicht, „ein Kind in romantische oder sinnliche Gespräche zu verwickeln“, falsche medizinische Informationen zu generieren und Benutzern zu helfen, zu argumentieren, dass Schwarze „dümmer als Weiße“ seien. Meta teilte danach mit, die Teile aus den Richtlinien entfernt zu haben, die Flirts und romantische Rollenspiele mit Minderjährigen gestatteten.

Fazit: Fachleute kritisieren die Meta-KI für Datenschutzrisiken, permanente Datenspeicherung und geringe Kontrollmöglichkeiten für Nutzerinnen und Nutzer. Der erste Satz im Kettenbrief ist jedoch falsch. Die Meta-KI kann laut Angaben in Whatsapp nur Nachrichten lesen, die Personen mit ihr teilen. Insbesondere in Chat-Gruppen hat ein Nutzer jedoch keine Kontrolle darüber, ob andere die KI zu einzelnen Nachrichten befragen. Das lässt sich vermeiden: In jedem Chat hat jedes Mitglied die Möglichkeit, den erweiterten Chat-Datenschutz zu aktivieren und so die Nutzung der Meta-KI auszuschließen.

Transparenzhinweis: CORRECTIV ist seit 2017 in einer Kooperation mit dem Konzern Meta, um Desinformation auf dem Sozialen Netzwerk zu bekämpfen. Mehr Informationen zu der Kooperation erhalten Sie hier. Über die aktuellen Entwicklungen zu dieser Kooperation hat CORRECTIV hier berichtet.

Redigatur: Steffen Kutzner, Matthias Bau